用caffe训练测试自己的图片

所有的操作是基于caffe的根目录/caffe-master/来操作的:

数据准备

我所用的图片是车牌识别中,0~9数字图片,在data下面新建一个number目录,用来存放训练图片(caffenumimg_train)与测试图片(caffenumimg_test),0~9分别有200张左右的训练图片和50张左右的测试图片

转换成lmdb格式文件

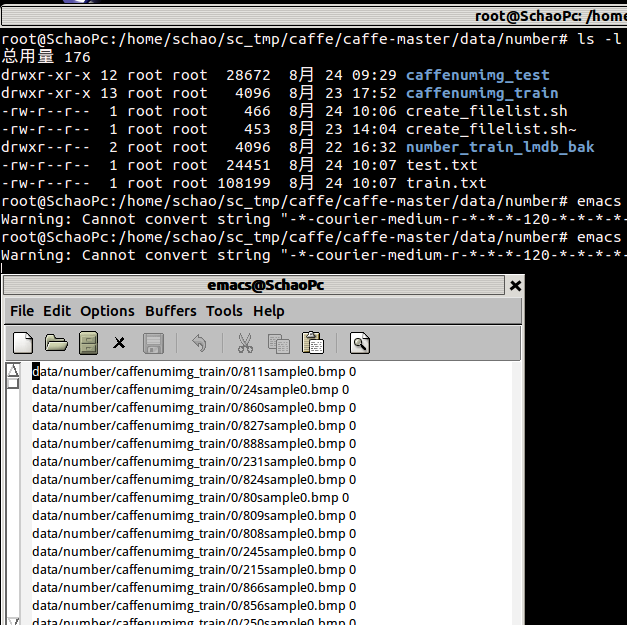

首先,在data/number/目录编写一个脚本create_filelist.sh文件,用来生成train.txt和test.txt清单文件。清单文件train.txt与test.txt主要用来记录训练图片与测试图片的目录与标签。

#!/usr/bin/env sh

DATA_TRAIN=data/number/caffenumimg_train

DATA_TEST=data/number/caffenumimg_test

MY=data/numberecho "Create train.txt..."

rm -rf $MY/train.txt

for i in 0 1 2 3 4 5 6 7 8 9

do

find $DATA_TRAIN/$i/ -name *.bmp | cut -d '/' -f1-5 | sed "s/$/ $i/">>$MY/train.txt

done

echo "Create test.txt..."

rm -rf $MY/test.txt

for i in 0 1 2 3 4 5 6 7 8 9

do

find $DATA_TEST/$i/ -name *.bmp | cut -d '/' -f1-5 | sed "s/$/ $i/">>$MY/test.txt

done

echo "All done"这段脚本的大致意思(生成test.txt与生成train.txt大体相同这里只介绍生成train.txt脚本的逻辑):

首先删除已经有的train.txt清单文件,然后遍历data/number/caffenumimg_train目录中的0~9文件夹,

读取所有的.bmp文件的目录,以/划分目录字段,截取1到5这几个字段,在字段结尾处加类别标签,保存到train.txt文件中。

然后,运行脚本

sh /data/number/create_filelist.sh得到如下图所示的结果:

接着再编写一个脚本文件放到目录examples/number/,调用convert_imageset命令来转换lmdb数据格式:

#!/usr/bin/env sh

# Create the imagenet lmdb inputs

# N.B. set the path to the imagenet train + val data dirs

set -eEXAMPLE=examples/number

DATA=data/number

TOOLS=build/toolsTRAIN_DATA_ROOT=./

TEST_DATA_ROOT=./rm $EXAMPLE/number_train_lmdb -rf

rm $EXAMPLE/number_test_lmdb -rf# Set RESIZE=true to resize the images to 256x256. Leave as false if images have

# already been resized using another tool.

RESIZE=true

if $RESIZE; thenRESIZE_HEIGHT=256RESIZE_WIDTH=256

elseRESIZE_HEIGHT=0RESIZE_WIDTH=0

fiif [ ! -d "$TRAIN_DATA_ROOT" ]; thenecho "Error: TRAIN_DATA_ROOT is not a path to a directory: $TRAIN_DATA_ROOT"echo "Set the TRAIN_DATA_ROOT variable in create_imagenet.sh to the path" \"where the ImageNet training data is stored."exit 1

fiif [ ! -d "$TEST_DATA_ROOT" ]; thenecho "Error: TEST_DATA_ROOT is not a path to a directory: $TEST_DATA_ROOT"echo "Set the TEST_DATA_ROOT variable in create_imagenet.sh to the path" \"where the ImageNet validation data is stored."exit 1

fiecho "Creating train lmdb..."GLOG_logtostderr=1 $TOOLS/convert_imageset \--resize_height=$RESIZE_HEIGHT \--resize_width=$RESIZE_WIDTH \--shuffle \$TRAIN_DATA_ROOT\$DATA/train.txt \$EXAMPLE/number_train_lmdbecho "Creating val lmdb..."GLOG_logtostderr=1 $TOOLS/convert_imageset \--resize_height=$RESIZE_HEIGHT \--resize_width=$RESIZE_WIDTH \--shuffle \$TEST_DATA_ROOT\$DATA/test.txt \$EXAMPLE/number_test_lmdbecho "Done."在caffe中,作者为我们提供了这样一个文件:convert_imageset.cpp,存放在根目录下的tools文件夹下。编译之后,生成对应的可执行文件放在 build/tools/ 下面,这个文件的作用就是用于将图片文件转换成caffe框架中能直接使用的db文件。

该文件的使用格式:

convert_imageset [FLAGS] ROOTFOLDER/LISTFILE DB_NAMEFLAGS: 图片参数组,具体有以下几个参数:

-gray: 是否以灰度图的方式打开图片。程序调用opencv库中的imread()函数来打开图片,默认为false

-shuffle: 是否随机打乱图片顺序。默认为false

-backend:需要转换成的db文件格式,可选为leveldb或lmdb,默认为lmdb

-resize_width/resize_height: 改变图片的大小。在运行中,要求所有图片的尺寸一致,因此需要改变图片大小。 程序调用opencv库的resize()函数来对图片放大缩小,默认为0,不改变

-check_size: 检查所有的数据是否有相同的尺寸。默认为false,不检查

-encoded: 是否将原图片编码放入最终的数据中,默认为false

-encode_type: 与前一个参数对应,将图片编码为哪一个格式:‘png’,’jpg’……

ROOTFOLDER/: 图片存放的绝对路径,从linux系统根目录开始 如上述脚本文件的TRAIN_DATA_ROOT

LISTFILE: 图片文件列表清单,一般为一个txt文件,一行一张图片,如上述截图k所示train.txt与test.txt

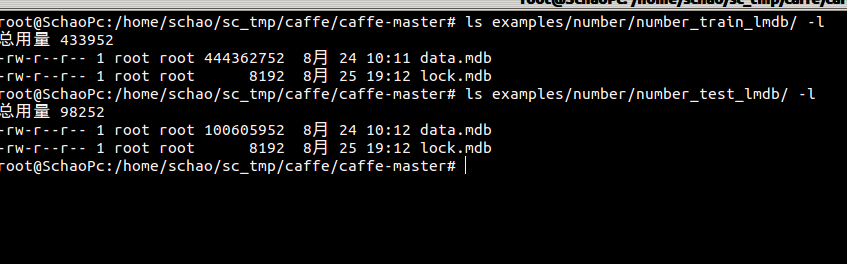

DB_NAME: 最终生成的db文件存放目录,如下截图所示的number_train_lmdb

运行成功后在 examples/number/下面生成两个文件夹number_test_lmdb和number_train_lmdb,分别用于保存训练图片与测试图片转换后的lmdb文件:

计算均值并保存

图片减去均值再训练,会提高训练速度和精度。因此,一般都会有这个操作。

caffe程序提供了一个计算均值的文件compute_image_mean.cpp,我们直接使用就可以了:

sudo build/tools/compute_image_mean examples/number/img_train_lmdb examples/number/mean.binaryproto创建模型并编写配置文件

模型就用程序自带的caffenet模型,位置在 models/bvlc_reference_caffenet/目录下, 将需要的两个配置文件solver.prototxt和train_val.prototxt,复制到examples/number/目录

修改solver.prototxt,指定网络配置的目录

net: "examples/number/train_val.prototxt"

test_iter: 20

test_interval: 40

base_lr: 0.01

lr_policy: "step"

gamma: 0.1

stepsize: 1000

display: 100

max_iter: 8000

momentum: 0.9

weight_decay: 0.0005

snapshot: 1000

snapshot_prefix: "examples/number/caffenet_train"

solver_mode: CPU每个参数的含义见http://blog.csdn.net/lanxuecc/article/details/52064799

这里进一步记录 我所看到的关于这些参数的含义:

net: "examples/number/train_val.prototxt"设置深度网络模型。每一个模型就是一个net,需要在一个专门的配置文件中对net进行配置,每个net由许多的layer所组成。每一个layer的具体配置方式后续会具体讲述!

test_iter: 20这个要与train_val.prototxt文件中test layer中的batch_size结合起来理解。mnist数据中测试样本总数为2000多张,一次性执行全部数据效率很低,因此我们将测试数据分成几个批次来执行,每个批次的数量就是batch_size。假设我们设置batch_size为100,则需要迭代20次才能将2000个数据全部执行完。因此test_iter设置为20。执行完一次全部数据,称之为一个epoch

test_interval: 40测试间隔。也就是每训练40次,进行一次测试。

base_lr: 0.01

lr_policy: "step"

gamma: 0.1

stepsize: 1000这四行可以放在一起理解,用于学习率的设置。只要是梯度下降法来求解优化,都会有一个学习率,也叫步长。base_lr用于设置基础学习率,在迭代的过程中,可以对基础学习率进行调整。怎么样进行调整,就是调整的策略,由lr_policy来设置。

lr_policy可以设置为下面这些值,相应的学习率的计算为:

- fixed: 保持base_lr不变.

- step: 如果设置为step,则还需要设置一个stepsize, 返回 base_lr * gamma ^ (floor(iter / stepsize)),其中iter表示当前的迭代次数

- exp: 返回base_lr * gamma ^ iter, iter为当前迭代次数

- inv: 如果设置为inv,还需要设置一个power, 返回base_lr * (1 + gamma * iter) ^ (- power)

- multistep: 如果设置为multistep,则还需要设置一个stepvalue。这个参数和step很相似,step是均匀等间隔变化,而multistep则是根据 stepvalue值变化

- poly: 学习率进行多项式误差, 返回 base_lr (1 - iter/max_iter) ^ (power)

- sigmoid: 学习率进行sigmod衰减,返回 base_lr ( 1/(1 + exp(-gamma * (iter - stepsize))))

momentum :0.9momentum是冲量单元,作用是有助于训练过程中逃离局部最小值,使网络能够更快速地收敛。如果上一次梯度方向与这一次的负梯度方向是相同的,那这次下降的幅度就会加大,所以这样做能够达到加速收敛的过程。

具体可看:https://www.zhihu.com/question/24529483

weight_decay: 0.0005权重衰减项,防止过拟合的一个参数。

具体可看:https://www.zhihu.com/question/24529483

snapshot: 1000

snapshot_prefix: "examples/number/caffenet_train"快照。将训练出来的model和solver状态进行保存,snapshot用于设置训练多少次后进行保存,默认为0,不保存。snapshot_prefix设置保存路径。

还可以设置snapshot_diff,是否保存梯度值,默认为false,不保存。

也可以设置snapshot_format,保存的类型。有两种选择:HDF5 和BINARYPROTO ,默认为BINARYPROTO

solver_mode: CPU设置运行模式。默认为GPU,如果你没有GPU,则需要改成CPU,否则会出错。

下面看下网络模型的具体设置:

name: "CaffeNet" #网络名称

#训练数据层^^^^^

layer {name: "data" #本层名称type: "Data" #本层类型:表明是数据层top: "data" #该层生成一个data blobtop: "label" #该层生成一个data blob#这一层只有top没有bottom,表明这层输出数据和标签include {phase: TRAIN #表明这层属于训练阶段的层}transform_param {mirror: true # 1表示开启镜像,0表示关闭,也可用ture和false来表示crop_size: 227 # 表示剪裁一个 227*227的图块,在训练阶段随机剪裁,在测试阶段从中间裁剪mean_file: "examples/number/mean.binaryproto" #指定均值文件}

# mean pixel / channel-wise mean instead of mean image

# transform_param {

# crop_size: 227

# mean_value: 104

# mean_value: 117

# mean_value: 123

# mirror: true

# }data_param {source: "examples/number/number_train_lmdb" #数据库的目录名称,指定数据位置batch_size: 100 #一次训练的样本数backend: LMDB #数据存储的数据类型}

}

#训练数据层vvvvv#测试数据层^^^^^

layer {name: "data"type: "Data"top: "data"top: "label"include {phase: TEST #表明这层属于测试阶段}transform_param {mirror: falsecrop_size: 227mean_file: "examples/number/mean.binaryproto" #就用训练的均值文件}

# mean pixel / channel-wise mean instead of mean image

# transform_param {

# crop_size: 227

# mean_value: 104

# mean_value: 117

# mean_value: 123

# mirror: false

# }data_param {source: "examples/number/number_test_lmdb"batch_size: 50 #每批次处理50个图片backend: LMDB}

}

#测试数据层vvvvv#第一个卷积层^^^^^

layer {name: "conv1"type: "Convolution" #表明这层是卷积层bottom: "data" #表明这层前面一层也就是下面一层是数据层,该层使用的数据是由数据层提供的data blobtop: "conv1" #该层生成的数据是conv1param {lr_mult: 1 #weight learning rate(简写为lr)权值的学习率,1表示该值是solver.prototxt中base_lr的1倍decay_mult: 1 #1表示该层的权重衰减是solver.prototxt中weight_decay的1倍}param {lr_mult: 2 #bias learning rate偏移值的学习率,2表示该值是solver.prototxt中base_lr的2倍decay_mult: 0 #偏移值的权重衰减为0}convolution_param {num_output: 96 #卷积核的个数kernel_size: 11 #卷积核的大小11×11,如果卷积核的长和宽不等,需要用 kernel_h 和 kernel_w 分别设定stride: 4 #卷积核移动的步幅为4weight_filler {type: "gaussian" ##常见两种初始化方式:xavier和gaussian#xavier算法,根据输入和输出的神经元的个数自动初始化权值比例std: 0.01}bias_filler {type: "constant" value: 0 #偏置项的初始化。将偏移值初始化为“稳定”状态, 值全为0。}}

}

#第一个卷积层vvvvv#激励层,具体作用见http://blog.sina.com.cn/s/blog_eb3aea990102v3um.html

layer {name: "relu1"type: "ReLU"bottom: "conv1" #表明它输入数据来自第一个卷积层top: "conv1" #表明它输出数据也放到第一个卷积层

}#池化层

layer {name: "pool1"type: "Pooling"bottom: "conv1"top: "pool1"pooling_param {pool: MAX #池化方法,为MAX。目前可用的方法有 MAX, AVE, 或 STOCHASTICkernel_size: 3 #池化核大小为3*3stride: 2 $池化核移动的步幅为2}

}#LRN层,具体作用http://blog.csdn.net/u014114990/article/details/47662189

layer {name: "norm1"type: "LRN"bottom: "pool1"top: "norm1"lrn_param {local_size: 5alpha: 0.0001beta: 0.75}

}#第二个卷积层

layer {name: "conv2"type: "Convolution"bottom: "norm1"top: "conv2"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}convolution_param {num_output: 256pad: 2 #扩充边缘,默认为0,不扩充。扩充的时候是左右、上下对称的,比如卷积核的大小为5*5,那么pad设置为2,则四个边缘都扩充2个像素,即宽度和高度都扩充了4个像素,这样卷积运算之后的特征图就不会变小。 也可以通过pad_h和pad_w来分别设定。kernel_size: 5group: 2weight_filler {type: "gaussian"std: 0.01}bias_filler {type: "constant"value: 1}}

}

layer {name: "relu2"type: "ReLU"bottom: "conv2"top: "conv2"

}

layer {name: "pool2"type: "Pooling"bottom: "conv2"top: "pool2"pooling_param {pool: MAXkernel_size: 3stride: 2}

}

layer {name: "norm2"type: "LRN"bottom: "pool2"top: "norm2"lrn_param {local_size: 5alpha: 0.0001beta: 0.75}

}

layer {name: "conv3"type: "Convolution"bottom: "norm2"top: "conv3"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}convolution_param {num_output: 384pad: 1kernel_size: 3weight_filler {type: "gaussian"std: 0.01}bias_filler {type: "constant"value: 0}}

}

layer {name: "relu3"type: "ReLU"bottom: "conv3"top: "conv3"

}

layer {name: "conv4"type: "Convolution"bottom: "conv3"top: "conv4"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}convolution_param {num_output: 384pad: 1kernel_size: 3group: 2weight_filler {type: "gaussian"std: 0.01}bias_filler {type: "constant"value: 1}}

}

layer {name: "relu4"type: "ReLU"bottom: "conv4"top: "conv4"

}

layer {name: "conv5"type: "Convolution"bottom: "conv4"top: "conv5"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}convolution_param {num_output: 256pad: 1kernel_size: 3group: 2weight_filler {type: "gaussian"std: 0.01}bias_filler {type: "constant"value: 1}}

}

layer {name: "relu5"type: "ReLU"bottom: "conv5"top: "conv5"

}

layer {name: "pool5"type: "Pooling"bottom: "conv5"top: "pool5"pooling_param {pool: MAXkernel_size: 3stride: 2}

}

#前面都是一些pool层,conv层 ReLU层 LRN层的重复,不再赘述#全连接层,参数含义与前面卷积层定义相同

layer {name: "fc6"type: "InnerProduct"bottom: "pool5"top: "fc6"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}inner_product_param {num_output: 4096weight_filler {type: "gaussian"std: 0.005}bias_filler {type: "constant"value: 1}}

}#激励层

layer {name: "relu6"type: "ReLU"bottom: "fc6"top: "fc6"

}#dropout层,具体见http://blog.csdn.net/u012702874/article/details/45030991

layer {name: "drop6"type: "Dropout"bottom: "fc6"top: "fc6"dropout_param {dropout_ratio: 0.5}

}#又是一个全连接层

layer {name: "fc7"type: "InnerProduct"bottom: "fc6"top: "fc7"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}inner_product_param {num_output: 4096weight_filler {type: "gaussian"std: 0.005}bias_filler {type: "constant"value: 1}}

}#激励层

layer {name: "relu7"type: "ReLU"bottom: "fc7"top: "fc7"

}#dropout层

layer {name: "drop7"type: "Dropout"bottom: "fc7"top: "fc7"dropout_param {dropout_ratio: 0.5}

}#全连接层

layer {name: "fc8"type: "InnerProduct"bottom: "fc7"top: "fc8"param {lr_mult: 1decay_mult: 1}param {lr_mult: 2decay_mult: 0}inner_product_param {num_output: 1000weight_filler {type: "gaussian"std: 0.01}bias_filler {type: "constant"value: 0}}

}#准确率结果层,测试时用,用来计算测试效果的准确率

layer {name: "accuracy"type: "Accuracy"bottom: "fc8"bottom: "label"top: "accuracy" include {phase: TEST}

}#损失函数层

layer {name: "loss"type: "SoftmaxWithLoss"bottom: "fc8"bottom: "label"top: "loss"

}感谢:::::::

http://blog.csdn.net/u012746763/article/details/51549184

http://blog.csdn.net/u012746763/article/details/51549267

http://stackoverflow.com/questions/30033096/what-is-lr-policy-in-caffe

http://blog.csdn.net/liuweizj12/article/details/52152911

http://www.cnblogs.com/denny402/p/5070928.html

http://www.cnblogs.com/Evence/p/5698621.html

http://www.cnblogs.com/xiaopanlyu/p/5793280.html

http://blog.csdn.net/strint/article/details/44163869

如若内容造成侵权/违法违规/事实不符,请联系编程学习网邮箱:809451989@qq.com进行投诉反馈,一经查实,立即删除!

相关文章

- 从键盘输入一个整数,判断该数字能否被 2 和 3 同时整除,能否被 2 整除, 能否被 3 整除,不能被 2 和 3 整除

从键盘输入一个整数,判断该数字能否被 2 和 3 同时整除,能否被 2 整除,能否被 3 整除,不能被 2 和 3 整除。输出相应信息。a input() bint(a) if b%20 and b%30:print(该数字能被 2 和 3 同时整除) elif b%20:print(该数字能被 2…...

2024/4/20 12:17:49 - QML中能使用什么JS库

QML中能使用什么JS库 JavaScript 是由 ECMAScipt 宿主环境构成的。 也就是说宿主环境不同,使用 JavaScript 编写 的库一般也是不兼容的。 例如宿主环境有常见的浏览器,有 nodejs,有 IOST 智能合约,当然也有 QML。 一般情况下…...

2024/4/25 8:58:40 - mybatis执行查询语句查询不到结果,控制台输出sql语句复制到数据库中能查到数据

今天用mybatis查询语句的时候,控制台输出的sql语句可以在mysql中可以正确执行,但是查询出来就是没有数据。 原查询语句如下(为展示问题明确,将sql进行了简化): <select id"getListByQueryValue&q…...

2024/4/28 4:49:09 - 求数组中能被3整除的元素并打印输出。

我这个程序执行定义一个数组,通过键盘输入数组元素,在输入的数组元素中找到能被3整除的元素并打印输出 int ar[]new int [5];Scanner scnew Scanner(System.in);for(int i0;i<5;i) {ar[i]sc.nextInt();}for(int j0;j<5;j) {if(ar[j]%30) System.ou…...

2024/4/27 22:05:51 - 问题:Java中,char型变量中能不能存储一个中文汉字,为什么?

为什么? char型变量是用来存储Unicode编码的字符的,unicode 编码字符集中包含了汉字,所以,char型变量中当然可以存储汉字。不过,如果某个特殊的汉字没有被包含在 unicode 编码字符集中,那么,这个…...

2024/4/28 4:48:12 - 正数的原码,反码,补码

这之前,遇到什么原码,反码,补码,就头疼,其实遇到一个自己怕的问题,就一定要解决它,吃掉它,这样心里的心结就解决了,不然等到以后,每次遇到都是跳过࿰…...

2024/4/27 23:45:29 - 真值 原码 补码 反码 移码

真值 原码 补码 反码 移码 真值是相对与其它四种的数字类型 书写中一般表示的数叫做"真值" 机器中编码表示的数 "机器数||机器码<原码 补码 反码 移码 >" 原码 反码 负数的反码是将其原码除符号位之外的各位求反 补码 负数的补码是将其原码除符号位…...

2024/4/21 1:44:13 - 原码、补码其实很简单

算术运算中的数值都带有符号以表示正负 计算机中用0表示正,用1表示负 原来带有“”、 “-”号的数据表示为真值 真值:x 1011 y-1011 机器数: x 01011 y11011 原码 二进制真值X的原码编码方法(n位) 对最高位对符号部分进行编码 用0表示’’ ,用1表示’-’ 剩…...

2024/4/21 1:44:13 - 原码,补码,反码的计算方式

8位二进制表示一个数,第一位是符号位,正数为 0,负数 为 1 原码,补码,反码的计算方式总结。 例子...

2024/4/20 20:38:05 - Java 语法

详细代码请参看 Java基础语法随堂代码 关键字(掌握) 定义 被Java语言赋予特定含义的单词特点: 全部小写。注意事项: A:goto和const作为保留字存在。B:类似于Notepad这样的高级记事本会对关键字有特殊颜色标记标识符(掌握) 定义 就是给类,接…...

2024/4/20 20:38:03 - 原码 补码及其计算

数值存储是以补码的形式存储, 也是一补码进行计算的 例如: 其实计算过程是: 0000 0001 ^ 1111 1111 ------------------- 1111 1110 这正好是 -2 的补码...

2024/4/20 20:38:02 - 纯小数转原码

最近在备考软考程序员,遇到了小数转原码的问题。百度竟然很少解析,自己历经千辛万苦找到了方法,在这里分享一下。 给出题目:若机器字长n等于8,求十进制-5.1875的原码。 方法:与整数求原码方法一致…...

2024/4/20 20:38:01 - 计算机原码,反码,补码

最近花了点时间对计算机的原码,反码和补码进行了研究,对为什么要有反码和补码以及他们这么设计的原因有了一定的理解 机器数 一个数在计算机中的表现形式叫做机器数,这个数有正负之分,在计算机中用一个数的最高位(符…...

2024/4/21 1:44:12 - 计算机组成原理

知识改变命运,储备成就未来。 计算机组成原理 1.第一台电子计算机何时何地诞生?英文全称? 1946年2月14日 美国宾夕法尼亚大学 ENIAC:电子数字积分计算机 Electronic(电子的) Numerical(数字的…...

2024/4/27 13:59:33 - 原码,反码,补码详解及原理

原码(1) 原码:在数值前直接加一符号位的表示法。例如: 符号位 数值位byte的取值范围[7]原 0 0000111 B[-7]原 1 0000111 B注意:byte的取值范围是-27~ 27-1 总计256个数即:无符号位 0~255 (因为计…...

2024/4/21 1:44:09 - 模,原码,补码,反码

模、原码和补码 在实际生活中,如果一个物体在正北方向30度,把该物体顺时针旋转100度,和把这个物体逆时针旋转260度得到的效果是一样的。再比如说钟表,时针从2点走11个单位,和逆时针走1个单位的位置是一样的。这两个例…...

2024/4/21 1:44:10 - 原码、补码、反码以及位运算

原码、补码、反码的概念以及位运算原码、补码、反码的概念以及位运算1 原码、补码、反码1.1 原码组成1.2 反码1.3 补码1.4 总结2 位运算2.1 按位与&2.2 按位或|2.3 按位异或^2.4 右移运算>>2.5 左移运算<<原码、补码、反码的概念以及位运算 1 原码、补码、反码…...

2024/4/21 1:44:07 - 原码除法运算(计算机组成原理19)

原码除法运算 视频链接地址: https://www.bilibili.com/video/BV1BE411D7ii?fromsearch&seid6420326887479343502计算机组成原理 系列文章目录原码除法运算前言1 除法运算思想2 原码除法:恢复余数法3 原码除法:加减交替法(不…...

2024/4/21 1:44:06 - 计算机原码、反码、补码、移码转换及范围

计算机原码、反码、补码、移码转换及范围 数据的表示: 数值1 数值-1 1-1 原码 0000 0001 1000 0001 1000 0010 反码 0000 0001 1111 1110 1111 1111 补码 0000 0001 1111 1111 0000 0000 移码 1000 0001 0111 1111 1000 000…...

2024/4/21 1:44:05 - 原码、反码、补码和移码

数值型数据的表示方法 1.1 进位计数制 数制的基与权 在任一数制中,每一个数上允许使用的计数符号的个数被称作该数制的基数。 每一位都对应一个表示该位在数码中的位置的值,这个值就被称为数位的权值w。 常用的几种进位制 (1)…...

2024/4/20 4:25:14

最新文章

- 学习java第五十三天

Spring器中的bean可以分为5个范围: singleton:这种bean范围是默认的,这种范围确保不管接受多少请求,每个容器中只有一个bean的实例,单例模式; prototype:为每一个bean提供一个实例;…...

2024/4/28 11:41:15 - 梯度消失和梯度爆炸的一些处理方法

在这里是记录一下梯度消失或梯度爆炸的一些处理技巧。全当学习总结了如有错误还请留言,在此感激不尽。 权重和梯度的更新公式如下: w w − η ⋅ ∇ w w w - \eta \cdot \nabla w ww−η⋅∇w 个人通俗的理解梯度消失就是网络模型在反向求导的时候出…...

2024/3/20 10:50:27 - 汽车疲劳测试试验平台技术要求(北重厂家)

汽车疲劳测试试验平台技术要求通常包括以下几个方面: 车辆加载能力:测试平台需要具备足够的承载能力,能够同时测试多种车型和不同重量的车辆。 动力系统:测试平台需要具备稳定可靠的动力系统,能够提供足够的力和速度来…...

2024/4/27 20:00:22 - 在 Visual Studio Code (VSCode) 中隐藏以 . 开头的文件

打开VSCode。 按下Ctrl ,快捷键打开设置。您也可以点击屏幕左下角的齿轮图标,然后选择“Settings”。 在设置搜索框中,键入files.exclude。 在找到的Files: Exclude项中,点击Add Pattern按钮来添加一个新的模式,或者直接在搜索…...

2024/4/22 21:08:05 - 【外汇早评】美通胀数据走低,美元调整

原标题:【外汇早评】美通胀数据走低,美元调整昨日美国方面公布了新一期的核心PCE物价指数数据,同比增长1.6%,低于前值和预期值的1.7%,距离美联储的通胀目标2%继续走低,通胀压力较低,且此前美国一季度GDP初值中的消费部分下滑明显,因此市场对美联储后续更可能降息的政策…...

2024/4/26 18:09:39 - 【原油贵金属周评】原油多头拥挤,价格调整

原标题:【原油贵金属周评】原油多头拥挤,价格调整本周国际劳动节,我们喜迎四天假期,但是整个金融市场确实流动性充沛,大事频发,各个商品波动剧烈。美国方面,在本周四凌晨公布5月份的利率决议和新闻发布会,维持联邦基金利率在2.25%-2.50%不变,符合市场预期。同时美联储…...

2024/4/28 3:28:32 - 【外汇周评】靓丽非农不及疲软通胀影响

原标题:【外汇周评】靓丽非农不及疲软通胀影响在刚结束的周五,美国方面公布了新一期的非农就业数据,大幅好于前值和预期,新增就业重新回到20万以上。具体数据: 美国4月非农就业人口变动 26.3万人,预期 19万人,前值 19.6万人。 美国4月失业率 3.6%,预期 3.8%,前值 3…...

2024/4/26 23:05:52 - 【原油贵金属早评】库存继续增加,油价收跌

原标题:【原油贵金属早评】库存继续增加,油价收跌周三清晨公布美国当周API原油库存数据,上周原油库存增加281万桶至4.692亿桶,增幅超过预期的74.4万桶。且有消息人士称,沙特阿美据悉将于6月向亚洲炼油厂额外出售更多原油,印度炼油商预计将每日获得至多20万桶的额外原油供…...

2024/4/27 4:00:35 - 【外汇早评】日本央行会议纪要不改日元强势

原标题:【外汇早评】日本央行会议纪要不改日元强势近两日日元大幅走强与近期市场风险情绪上升,避险资金回流日元有关,也与前一段时间的美日贸易谈判给日本缓冲期,日本方面对汇率问题也避免继续贬值有关。虽然今日早间日本央行公布的利率会议纪要仍然是支持宽松政策,但这符…...

2024/4/27 17:58:04 - 【原油贵金属早评】欧佩克稳定市场,填补伊朗问题的影响

原标题:【原油贵金属早评】欧佩克稳定市场,填补伊朗问题的影响近日伊朗局势升温,导致市场担忧影响原油供给,油价试图反弹。此时OPEC表态稳定市场。据消息人士透露,沙特6月石油出口料将低于700万桶/日,沙特已经收到石油消费国提出的6月份扩大出口的“适度要求”,沙特将满…...

2024/4/27 14:22:49 - 【外汇早评】美欲与伊朗重谈协议

原标题:【外汇早评】美欲与伊朗重谈协议美国对伊朗的制裁遭到伊朗的抗议,昨日伊朗方面提出将部分退出伊核协议。而此行为又遭到欧洲方面对伊朗的谴责和警告,伊朗外长昨日回应称,欧洲国家履行它们的义务,伊核协议就能保证存续。据传闻伊朗的导弹已经对准了以色列和美国的航…...

2024/4/28 1:28:33 - 【原油贵金属早评】波动率飙升,市场情绪动荡

原标题:【原油贵金属早评】波动率飙升,市场情绪动荡因中美贸易谈判不安情绪影响,金融市场各资产品种出现明显的波动。随着美国与中方开启第十一轮谈判之际,美国按照既定计划向中国2000亿商品征收25%的关税,市场情绪有所平复,已经开始接受这一事实。虽然波动率-恐慌指数VI…...

2024/4/27 9:01:45 - 【原油贵金属周评】伊朗局势升温,黄金多头跃跃欲试

原标题:【原油贵金属周评】伊朗局势升温,黄金多头跃跃欲试美国和伊朗的局势继续升温,市场风险情绪上升,避险黄金有向上突破阻力的迹象。原油方面稍显平稳,近期美国和OPEC加大供给及市场需求回落的影响,伊朗局势并未推升油价走强。近期中美贸易谈判摩擦再度升级,美国对中…...

2024/4/27 17:59:30 - 【原油贵金属早评】市场情绪继续恶化,黄金上破

原标题:【原油贵金属早评】市场情绪继续恶化,黄金上破周初中国针对于美国加征关税的进行的反制措施引发市场情绪的大幅波动,人民币汇率出现大幅的贬值动能,金融市场受到非常明显的冲击。尤其是波动率起来之后,对于股市的表现尤其不安。隔夜美国股市出现明显的下行走势,这…...

2024/4/25 18:39:16 - 【外汇早评】美伊僵持,风险情绪继续升温

原标题:【外汇早评】美伊僵持,风险情绪继续升温昨日沙特两艘油轮再次发生爆炸事件,导致波斯湾局势进一步恶化,市场担忧美伊可能会出现摩擦生火,避险品种获得支撑,黄金和日元大幅走强。美指受中美贸易问题影响而在低位震荡。继5月12日,四艘商船在阿联酋领海附近的阿曼湾、…...

2024/4/28 1:34:08 - 【原油贵金属早评】贸易冲突导致需求低迷,油价弱势

原标题:【原油贵金属早评】贸易冲突导致需求低迷,油价弱势近日虽然伊朗局势升温,中东地区几起油船被袭击事件影响,但油价并未走高,而是出于调整结构中。由于市场预期局势失控的可能性较低,而中美贸易问题导致的全球经济衰退风险更大,需求会持续低迷,因此油价调整压力较…...

2024/4/26 19:03:37 - 氧生福地 玩美北湖(上)——为时光守候两千年

原标题:氧生福地 玩美北湖(上)——为时光守候两千年一次说走就走的旅行,只有一张高铁票的距离~ 所以,湖南郴州,我来了~ 从广州南站出发,一个半小时就到达郴州西站了。在动车上,同时改票的南风兄和我居然被分到了一个车厢,所以一路非常愉快地聊了过来。 挺好,最起…...

2024/4/28 1:22:35 - 氧生福地 玩美北湖(中)——永春梯田里的美与鲜

原标题:氧生福地 玩美北湖(中)——永春梯田里的美与鲜一觉醒来,因为大家太爱“美”照,在柳毅山庄去寻找龙女而错过了早餐时间。近十点,向导坏坏还是带着饥肠辘辘的我们去吃郴州最富有盛名的“鱼头粉”。说这是“十二分推荐”,到郴州必吃的美食之一。 哇塞!那个味美香甜…...

2024/4/25 18:39:14 - 氧生福地 玩美北湖(下)——奔跑吧骚年!

原标题:氧生福地 玩美北湖(下)——奔跑吧骚年!让我们红尘做伴 活得潇潇洒洒 策马奔腾共享人世繁华 对酒当歌唱出心中喜悦 轰轰烈烈把握青春年华 让我们红尘做伴 活得潇潇洒洒 策马奔腾共享人世繁华 对酒当歌唱出心中喜悦 轰轰烈烈把握青春年华 啊……啊……啊 两…...

2024/4/26 23:04:58 - 扒开伪装医用面膜,翻六倍价格宰客,小姐姐注意了!

原标题:扒开伪装医用面膜,翻六倍价格宰客,小姐姐注意了!扒开伪装医用面膜,翻六倍价格宰客!当行业里的某一品项火爆了,就会有很多商家蹭热度,装逼忽悠,最近火爆朋友圈的医用面膜,被沾上了污点,到底怎么回事呢? “比普通面膜安全、效果好!痘痘、痘印、敏感肌都能用…...

2024/4/27 23:24:42 - 「发现」铁皮石斛仙草之神奇功效用于医用面膜

原标题:「发现」铁皮石斛仙草之神奇功效用于医用面膜丽彦妆铁皮石斛医用面膜|石斛多糖无菌修护补水贴19大优势: 1、铁皮石斛:自唐宋以来,一直被列为皇室贡品,铁皮石斛生于海拔1600米的悬崖峭壁之上,繁殖力差,产量极低,所以古代仅供皇室、贵族享用 2、铁皮石斛自古民间…...

2024/4/28 5:48:52 - 丽彦妆\医用面膜\冷敷贴轻奢医学护肤引导者

原标题:丽彦妆\医用面膜\冷敷贴轻奢医学护肤引导者【公司简介】 广州华彬企业隶属香港华彬集团有限公司,专注美业21年,其旗下品牌: 「圣茵美」私密荷尔蒙抗衰,产后修复 「圣仪轩」私密荷尔蒙抗衰,产后修复 「花茵莳」私密荷尔蒙抗衰,产后修复 「丽彦妆」专注医学护…...

2024/4/26 19:46:12 - 广州械字号面膜生产厂家OEM/ODM4项须知!

原标题:广州械字号面膜生产厂家OEM/ODM4项须知!广州械字号面膜生产厂家OEM/ODM流程及注意事项解读: 械字号医用面膜,其实在我国并没有严格的定义,通常我们说的医美面膜指的应该是一种「医用敷料」,也就是说,医用面膜其实算作「医疗器械」的一种,又称「医用冷敷贴」。 …...

2024/4/27 11:43:08 - 械字号医用眼膜缓解用眼过度到底有无作用?

原标题:械字号医用眼膜缓解用眼过度到底有无作用?医用眼膜/械字号眼膜/医用冷敷眼贴 凝胶层为亲水高分子材料,含70%以上的水分。体表皮肤温度传导到本产品的凝胶层,热量被凝胶内水分子吸收,通过水分的蒸发带走大量的热量,可迅速地降低体表皮肤局部温度,减轻局部皮肤的灼…...

2024/4/27 8:32:30 - 配置失败还原请勿关闭计算机,电脑开机屏幕上面显示,配置失败还原更改 请勿关闭计算机 开不了机 这个问题怎么办...

解析如下:1、长按电脑电源键直至关机,然后再按一次电源健重启电脑,按F8健进入安全模式2、安全模式下进入Windows系统桌面后,按住“winR”打开运行窗口,输入“services.msc”打开服务设置3、在服务界面,选中…...

2022/11/19 21:17:18 - 错误使用 reshape要执行 RESHAPE,请勿更改元素数目。

%读入6幅图像(每一幅图像的大小是564*564) f1 imread(WashingtonDC_Band1_564.tif); subplot(3,2,1),imshow(f1); f2 imread(WashingtonDC_Band2_564.tif); subplot(3,2,2),imshow(f2); f3 imread(WashingtonDC_Band3_564.tif); subplot(3,2,3),imsho…...

2022/11/19 21:17:16 - 配置 已完成 请勿关闭计算机,win7系统关机提示“配置Windows Update已完成30%请勿关闭计算机...

win7系统关机提示“配置Windows Update已完成30%请勿关闭计算机”问题的解决方法在win7系统关机时如果有升级系统的或者其他需要会直接进入一个 等待界面,在等待界面中我们需要等待操作结束才能关机,虽然这比较麻烦,但是对系统进行配置和升级…...

2022/11/19 21:17:15 - 台式电脑显示配置100%请勿关闭计算机,“准备配置windows 请勿关闭计算机”的解决方法...

有不少用户在重装Win7系统或更新系统后会遇到“准备配置windows,请勿关闭计算机”的提示,要过很久才能进入系统,有的用户甚至几个小时也无法进入,下面就教大家这个问题的解决方法。第一种方法:我们首先在左下角的“开始…...

2022/11/19 21:17:14 - win7 正在配置 请勿关闭计算机,怎么办Win7开机显示正在配置Windows Update请勿关机...

置信有很多用户都跟小编一样遇到过这样的问题,电脑时发现开机屏幕显现“正在配置Windows Update,请勿关机”(如下图所示),而且还需求等大约5分钟才干进入系统。这是怎样回事呢?一切都是正常操作的,为什么开时机呈现“正…...

2022/11/19 21:17:13 - 准备配置windows 请勿关闭计算机 蓝屏,Win7开机总是出现提示“配置Windows请勿关机”...

Win7系统开机启动时总是出现“配置Windows请勿关机”的提示,没过几秒后电脑自动重启,每次开机都这样无法进入系统,此时碰到这种现象的用户就可以使用以下5种方法解决问题。方法一:开机按下F8,在出现的Windows高级启动选…...

2022/11/19 21:17:12 - 准备windows请勿关闭计算机要多久,windows10系统提示正在准备windows请勿关闭计算机怎么办...

有不少windows10系统用户反映说碰到这样一个情况,就是电脑提示正在准备windows请勿关闭计算机,碰到这样的问题该怎么解决呢,现在小编就给大家分享一下windows10系统提示正在准备windows请勿关闭计算机的具体第一种方法:1、2、依次…...

2022/11/19 21:17:11 - 配置 已完成 请勿关闭计算机,win7系统关机提示“配置Windows Update已完成30%请勿关闭计算机”的解决方法...

今天和大家分享一下win7系统重装了Win7旗舰版系统后,每次关机的时候桌面上都会显示一个“配置Windows Update的界面,提示请勿关闭计算机”,每次停留好几分钟才能正常关机,导致什么情况引起的呢?出现配置Windows Update…...

2022/11/19 21:17:10 - 电脑桌面一直是清理请关闭计算机,windows7一直卡在清理 请勿关闭计算机-win7清理请勿关机,win7配置更新35%不动...

只能是等着,别无他法。说是卡着如果你看硬盘灯应该在读写。如果从 Win 10 无法正常回滚,只能是考虑备份数据后重装系统了。解决来方案一:管理员运行cmd:net stop WuAuServcd %windir%ren SoftwareDistribution SDoldnet start WuA…...

2022/11/19 21:17:09 - 计算机配置更新不起,电脑提示“配置Windows Update请勿关闭计算机”怎么办?

原标题:电脑提示“配置Windows Update请勿关闭计算机”怎么办?win7系统中在开机与关闭的时候总是显示“配置windows update请勿关闭计算机”相信有不少朋友都曾遇到过一次两次还能忍但经常遇到就叫人感到心烦了遇到这种问题怎么办呢?一般的方…...

2022/11/19 21:17:08 - 计算机正在配置无法关机,关机提示 windows7 正在配置windows 请勿关闭计算机 ,然后等了一晚上也没有关掉。现在电脑无法正常关机...

关机提示 windows7 正在配置windows 请勿关闭计算机 ,然后等了一晚上也没有关掉。现在电脑无法正常关机以下文字资料是由(历史新知网www.lishixinzhi.com)小编为大家搜集整理后发布的内容,让我们赶快一起来看一下吧!关机提示 windows7 正在配…...

2022/11/19 21:17:05 - 钉钉提示请勿通过开发者调试模式_钉钉请勿通过开发者调试模式是真的吗好不好用...

钉钉请勿通过开发者调试模式是真的吗好不好用 更新时间:2020-04-20 22:24:19 浏览次数:729次 区域: 南阳 > 卧龙 列举网提醒您:为保障您的权益,请不要提前支付任何费用! 虚拟位置外设器!!轨迹模拟&虚拟位置外设神器 专业用于:钉钉,外勤365,红圈通,企业微信和…...

2022/11/19 21:17:05 - 配置失败还原请勿关闭计算机怎么办,win7系统出现“配置windows update失败 还原更改 请勿关闭计算机”,长时间没反应,无法进入系统的解决方案...

前几天班里有位学生电脑(windows 7系统)出问题了,具体表现是开机时一直停留在“配置windows update失败 还原更改 请勿关闭计算机”这个界面,长时间没反应,无法进入系统。这个问题原来帮其他同学也解决过,网上搜了不少资料&#x…...

2022/11/19 21:17:04 - 一个电脑无法关闭计算机你应该怎么办,电脑显示“清理请勿关闭计算机”怎么办?...

本文为你提供了3个有效解决电脑显示“清理请勿关闭计算机”问题的方法,并在最后教给你1种保护系统安全的好方法,一起来看看!电脑出现“清理请勿关闭计算机”在Windows 7(SP1)和Windows Server 2008 R2 SP1中,添加了1个新功能在“磁…...

2022/11/19 21:17:03 - 请勿关闭计算机还原更改要多久,电脑显示:配置windows更新失败,正在还原更改,请勿关闭计算机怎么办...

许多用户在长期不使用电脑的时候,开启电脑发现电脑显示:配置windows更新失败,正在还原更改,请勿关闭计算机。。.这要怎么办呢?下面小编就带着大家一起看看吧!如果能够正常进入系统,建议您暂时移…...

2022/11/19 21:17:02 - 还原更改请勿关闭计算机 要多久,配置windows update失败 还原更改 请勿关闭计算机,电脑开机后一直显示以...

配置windows update失败 还原更改 请勿关闭计算机,电脑开机后一直显示以以下文字资料是由(历史新知网www.lishixinzhi.com)小编为大家搜集整理后发布的内容,让我们赶快一起来看一下吧!配置windows update失败 还原更改 请勿关闭计算机&#x…...

2022/11/19 21:17:01 - 电脑配置中请勿关闭计算机怎么办,准备配置windows请勿关闭计算机一直显示怎么办【图解】...

不知道大家有没有遇到过这样的一个问题,就是我们的win7系统在关机的时候,总是喜欢显示“准备配置windows,请勿关机”这样的一个页面,没有什么大碍,但是如果一直等着的话就要两个小时甚至更久都关不了机,非常…...

2022/11/19 21:17:00 - 正在准备配置请勿关闭计算机,正在准备配置windows请勿关闭计算机时间长了解决教程...

当电脑出现正在准备配置windows请勿关闭计算机时,一般是您正对windows进行升级,但是这个要是长时间没有反应,我们不能再傻等下去了。可能是电脑出了别的问题了,来看看教程的说法。正在准备配置windows请勿关闭计算机时间长了方法一…...

2022/11/19 21:16:59 - 配置失败还原请勿关闭计算机,配置Windows Update失败,还原更改请勿关闭计算机...

我们使用电脑的过程中有时会遇到这种情况,当我们打开电脑之后,发现一直停留在一个界面:“配置Windows Update失败,还原更改请勿关闭计算机”,等了许久还是无法进入系统。如果我们遇到此类问题应该如何解决呢࿰…...

2022/11/19 21:16:58 - 如何在iPhone上关闭“请勿打扰”

Apple’s “Do Not Disturb While Driving” is a potentially lifesaving iPhone feature, but it doesn’t always turn on automatically at the appropriate time. For example, you might be a passenger in a moving car, but your iPhone may think you’re the one dri…...

2022/11/19 21:16:57