MapReduce 快速入门

文章目录

- 1. MapReduce 概述

- 1.1 MapReduce 定义

- 1.2 MapReduce 优缺点

- 1.3 MapReduce 核心思想

- 1.4 MapReduce 进程

- 1.5 MapReduce 编程规范

- 1.6 WordCount 案例实操

- 1.6.1 需求

- 1.6.2 需求分析

- 1.6.3 编写程序

- 2. Hadoop 序列化

- 2.1 序列化概述

- 2.2 自定义 bean 对象实现序列化接口

- 2.3 序列化案例实操

- 2.3.1 需求

- 2.3.2 需求分析

- 2.3.3 编写 MapReduce 程序

- 3. MapReduce 框架原理

- 3.1 InputFormat 数据输入

- 3.1.1 切片与 MapTask 并行度决定机制

- 3.1.2 Job 提交流程源码解析

- 3.1.3 FileInputFormat 切片源码解析

- 3.1.4 FileInputFormat 切片机制

- 3.1.5 CombineTextInputFormat 切片机制

- 3.1.6 FileInputFormat 实现类

- 3.1.7 KeyValueTextInputFormat 使用案例

- 3.1.8 NLineInputFormat 使用案例

- 3.1.9 自定义 InputFormat 使用案例

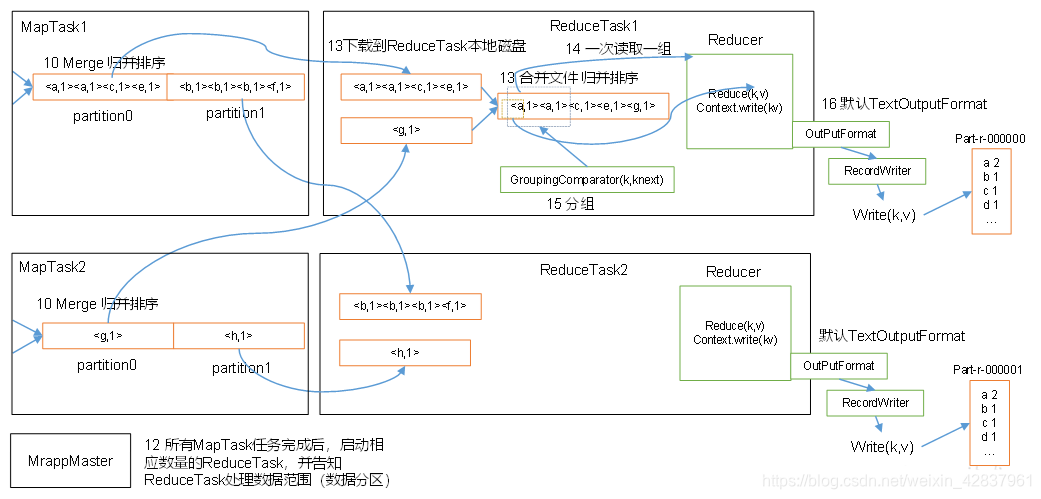

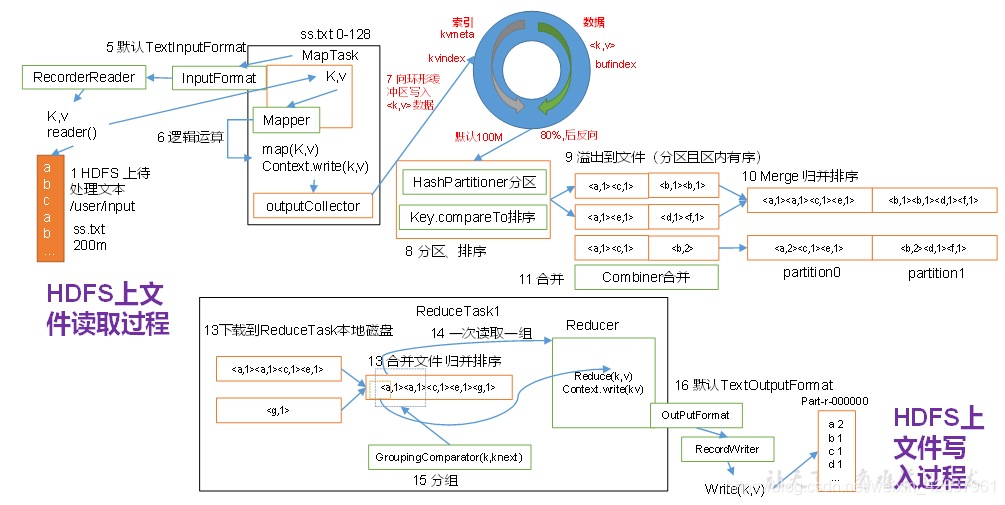

- 3.2 MapReduce 工作流程

- 3.3 Shuffle 机制

- 3.3.1 Shuffle 机制

- 3.3.2 Partition 分区

- 3.3.3 Partition 分区案例实操

- 3.3.4 WritableComparable 排序

- 3.3.5 全排序案例实操

- 3.3.6 区内排序案例实操

- 3.3.7 Combiner 合并

- 3.3.8 Combiner 合并案例实操

- 3.3.9 分组(辅助)排序

- 3.3.10 分组案例实操

- 3.4 MapTask 工作机制

- 3.5 ReduceTask 工作机制

- 3.6 OutputFormat 数据输出

- 3.6.1 OutputFormat 接口实现类

- 3.6.2 自定义 OutputFormat

- 3.6.3 自定义 OutputFormat 案例实操

- 3.7 Join 多种应用

- 3.7.1 Reduce Join

- 3.7.2 Reduce Join 案例实操

- 3.7.3 Map Join

- 3.7.4 Map Join 案例实操

- 3.8 计数器应用

- 3.9 数据清洗(ETL)

- 3.9.1 数据清洗案例实操-简单解析版

- 3.10 MapReduce 开发总结

- 4. Hadoop 数据压缩

- 4.1 概述

- 4.2 MR 支持的压缩编码

- 4.3 压缩方式选择

- 4.3.1 Gzip 压缩

- 4.3.2 Bzip2 压缩

- 4.3.3 Lzo 压缩

- 4.3.4 Snappy 压缩

- 4.4 压缩位置选择

- 4.5 压缩参数配置

- 4.6 压缩实操案例

- 4.6.1 数据流的压缩和解压缩

- 4.6.2 Map 输出端采用压缩

- 4.6.3 Reduce 输出端采用压缩

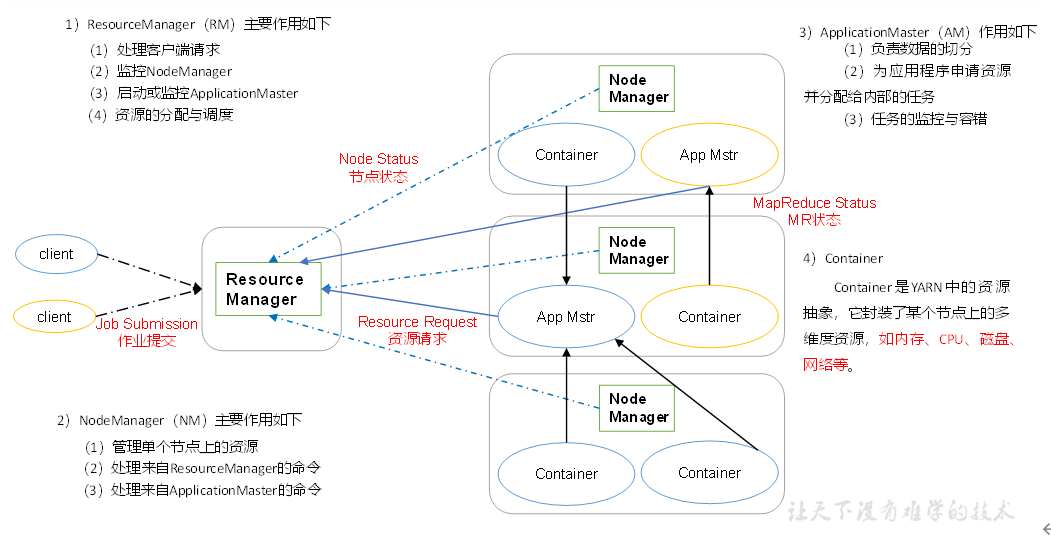

- 5. Yarn 资源调度器

- 5.1 Yarn 基本架构

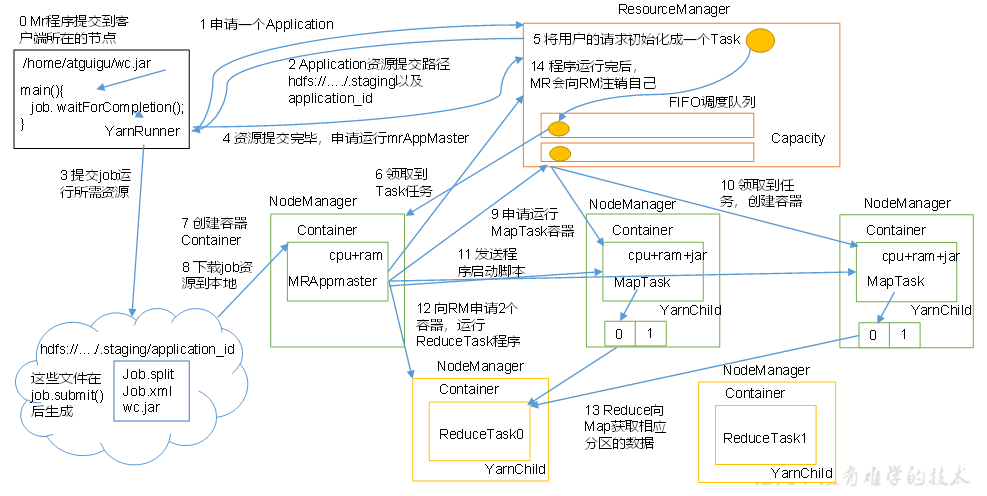

- 5.2 Yarn 工作机制

- 5.3 作业提交全过程

- 5.3.1 作业提交过程之 YARN

- 5.3.2 作业提交过程之 MapReduce

- 5.4 资源调度器

- 5.5 任务的推测执行

- 6. Hadoop 企业优化

- 6.1 MapReduce 跑的慢的原因

- 6.2 MapReduce 优化方法

- 6.2.1 数据输入

- 6.2.2 Map 阶段

- 6.2.3 Reduce 阶段

- 6.2.4 I/O 传输

- 6.2.5 数据倾斜问题

- 6.2.6 常用的调优参数

- 6.3 HDFS 小文件优化方法

1. MapReduce 概述

1.1 MapReduce 定义

MapReduce 是一个分布式运算程序的编程框架,是用户开发 “基于 Hadoop 的数据分析应用” 的核心框架。

MapReduce 核心功能是将用户编写的业务逻辑代码和自带默认组件整合成一个完整的分布式运算程序,并发运行在一个 Hadoop 集群上。

1.2 MapReduce 优缺点

-

优点

① MapReduce 易于编程

它简单的实现一些接口,就可以完成一个分布式程序,这个分布式程序可以分布到大量廉价的 PC 机器运行。也就是说你写一个分布式程序,跟写一个简单的串行程序是一模一样的。 就是因为这个特点使得 MapReduce 编程变得非常流行。

② 良好的扩展性

当你的计算资源不能得到满足的时候,你可以通过简单的增加机器来扩展它的计算能力。

③ 高容错性

MapReduce 设计的初衷就是使程序能够部署在廉价的 PC 机器上,这就要求它具有很高的容错性。比如其中一台机器挂了,它可以把上面的计算任务转移到另外一个节点上面上运行,不至于这个任务运行失败,而且这个过程不需要人工参与,而完全是由 Hadoop 内部完成的。

④ 适合 PB 级以上海量数据的离线处理

离线处理,说明它适合离线处理而不适合在线处理。比如像毫秒级别的返回一个结果,MapReduce 很难做到。

-

缺点

MapReduce 不擅长做实时计算、流式计算、DAG(有向图)计算。

① 实时计算

MapReduce 无法像 Mysql 一样,在毫秒或者秒级内返回结果。

② 流式计算

流式计算的输入数据是动态的,而 MapReduce 的输入数据集是静态的,不能动态变化。这是因为 MapReduce 自身的设计特点决定了数据源必须是静态的。

③ DAG(有向图)计算

多个应用程序存在依赖关系,后一个应用程序的输入为前一个的输出。在这种情况下,MapReduce 并不是不能做,而是使用后,每个 MapReduce 作业的输出结果都会写入到磁盘,会造成大量的磁盘 IO,导致性能非常的低下。

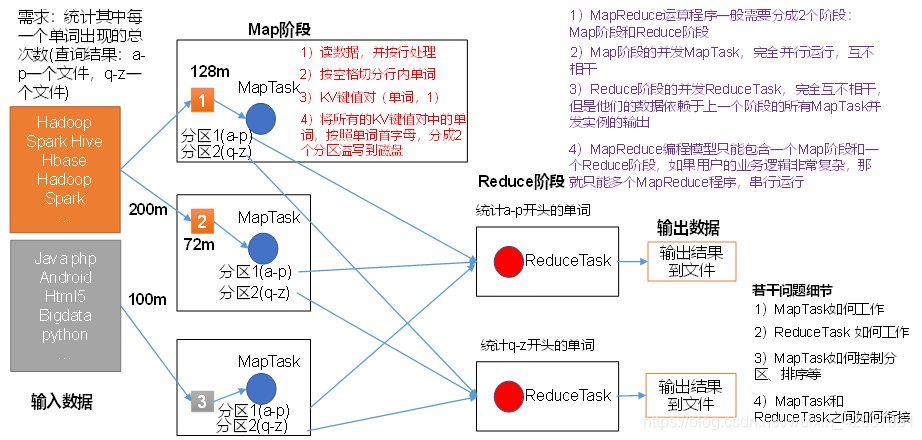

1.3 MapReduce 核心思想

1.4 MapReduce 进程

一个完整的 MapReduce 程序在分布式运行时有三类实例进程:

- MrAppMaster: 负责整个程序的过程调度及状态协调。

- Map Task: 负责Ma阶段的整个数据处理流程。

- ReduceTask: 负责Reduce阶段的整个数据处理流程。

1.5 MapReduce 编程规范

用户编写的程序分成三个部分:Mapper,Reducer,Driver(提交运行 mr 程序的客户端)

-

Mapper 阶段

(1)用户自定义的 Mapper 要继承自己的父类

(2)Mapper 的输入数据是 KV 对的形式(KV 的类型可自定义)

(3)Mapper 中的业务逻辑写在 map() 方法中

(4)Mapper 的输出数据是 KV 对的形式(KV的类型可自定义)

(5)map() 方法(maptask 进程)对每一个 <K,V> 调用一次 -

Reducer 阶段

(1)用户自定义的 Reducer 要继承自己的父类

(2)Reducer 的输入数据类型对应 Mapper 的输出数据类型,也是 KV

(3)Reducer 的业务逻辑写在 reduce() 方法中

(4)Reducetask 进程对每一组相同 K 的 <K,V> 组调用一次 reduce() 方法 -

Driver 阶段

整个程序需要一个 Drvier 来进行提交,提交的是一个描述了各种必要信息的 job 对象

1.6 WordCount 案例实操

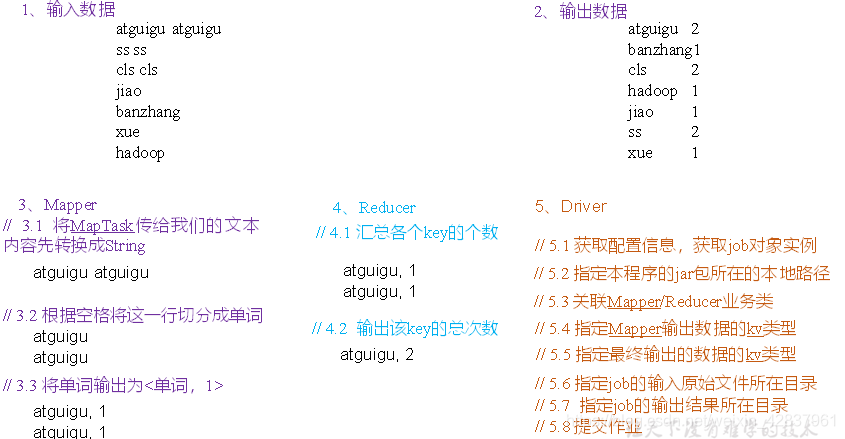

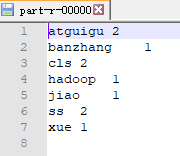

1.6.1 需求

在给定的文本文件中统计输出每一个单词出现的总次数

- 输入数据 hello.txt

atguigu atguigu

ss ss

cls cls

jiao

banzhang

xue

hadoop

- 期望输出数据

atguigu 2

banzhang 1

cls 2

hadoop 1

jiao 1

ss 2

xue 1

1.6.2 需求分析

1.6.3 编写程序

- 创建一个 maven 项目 mr

- 导入以下依赖

<dependencies><dependency><groupId>junit</groupId><artifactId>junit</artifactId><version>RELEASE</version></dependency><dependency><groupId>org.apache.logging.log4j</groupId><artifactId>log4j-core</artifactId><version>2.8.2</version></dependency><dependency><groupId>org.apache.hadoop</groupId><artifactId>hadoop-common</artifactId><version>2.7.7</version></dependency><dependency><groupId>org.apache.hadoop</groupId><artifactId>hadoop-client</artifactId><version>2.7.7</version></dependency><dependency><groupId>org.apache.hadoop</groupId><artifactId>hadoop-hdfs</artifactId><version>2.7.7</version></dependency>

</dependencies>

- 在项目的 src/main/resources 目录下,新建一个文件,命名为 “log4j.properties”,在文件中填入以下内容:

log4j.rootLogger=INFO, stdout

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spring.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

- 编写 Mapper 类

package mr.wordcount;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class WordCountMapper extends Mapper<LongWritable, Text, Text, IntWritable> {Text k = new Text();IntWritable v = new IntWritable(1);@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行String line = value.toString();// 2 切割String[] words = line.split(" ");// 3 输出for (String word : words) {k.set(word);context.write(k, v);}}

}

- 编写 Reducer 类

package mr.wordcount;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class WordCountReducer extends Reducer<Text, IntWritable, Text, IntWritable> {int sum;IntWritable v = new IntWritable();@Overrideprotected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {// 1 累加求和sum = 0;for (IntWritable count : values) {sum += count.get();}// 2 输出v.set(sum);context.write(key, v);}

}

- 编写 Driver 类

package mr.wordcount;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class WordCountDriver {public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {// 1 获取job对象Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 2 设置jar加载路径job.setJarByClass(WordCountDriver.class);// 3 关联map和reduce类job.setMapperClass(WordCountMapper.class);job.setReducerClass(WordCountReducer.class);// 4 设置map输出阶段的KV类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(IntWritable.class);// 5 设置最终输出KV类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(IntWritable.class);// 6 设置输入和输出路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 7 提交

// job.submit();boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

-

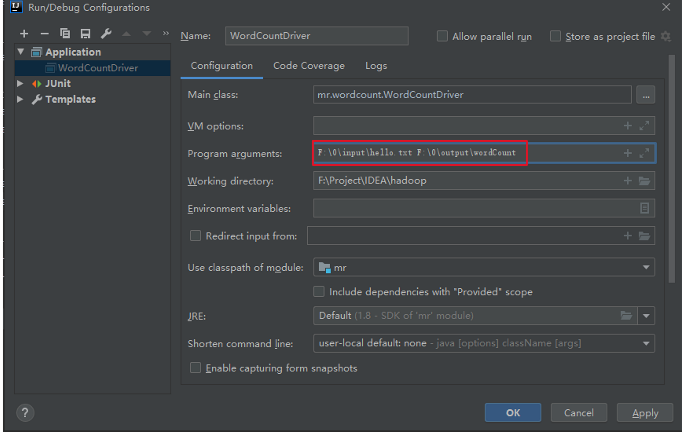

本地测试

输入程序的输入路径和输出路径

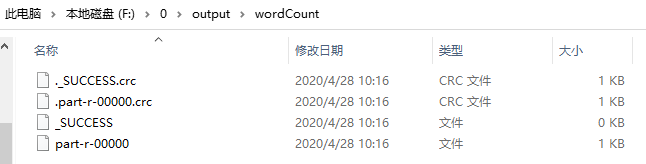

运行后查看结果

-

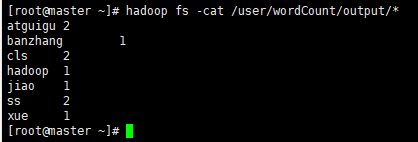

集群上测试

① 在 pom.xml 里面设置编译版本(默认的 1.5 版本,编译时 idea 会报错)

<properties><project.build.sourceEncoding>UTF-8</project.build.sourceEncoding><maven.compiler.source>1.8</maven.compiler.source><maven.compiler.target>1.8</maven.compiler.target>

</properties>

② 将程序打成 jar 包,重命名为 wc.jar 然后拷贝到 Hadoop 集群中

③ 执行 WordCount 程序

hadoop jar wc.jar mr.wordcount.WordCountDriver /user/wordCount/input /user/wordcount/output

④ 查看结果

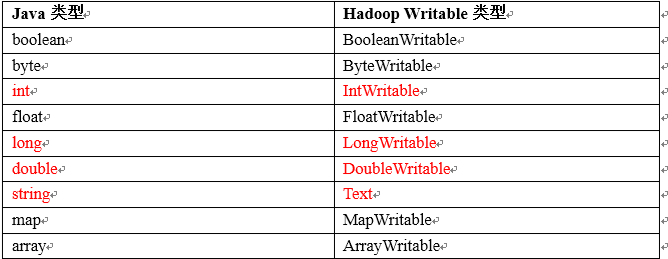

2. Hadoop 序列化

2.1 序列化概述

-

什么是序列化

序列化就是把内存中的对象,转换成字节序列(或其他数据传输协议)以便于存储(持久化)和网络传输。

反序列化就是将收到字节序列(或其他数据传输协议)或者是硬盘的持久化数据,转换成内存中的对象。 -

为什么要序列化

一般来说,“活的”对象只生存在内存里,关机断电就没有了。而且“活的”对象只能由本地的进程使用,不能被发送到网络上的另外一台计算机。然而序列化可以存储“活的”对象,可以将“活的”对象发送到远程计算机。

-

为什么不用 Java 的序列化

Java 的序列化是一个重量级序列化框架(Serializable),一个对象被序列化后,会附带很多额外的信息(各种校验信息,header,继承体系等),不便于在网络中高效传输。所以,hadoop 自己开发了一套序列化机制(Writable),精简、高效。

-

Hadoop 序列化的特点

① 紧凑:高效实用存储空间。

② 快速:读写数据的额外开销小。

③ 可扩展:随着通信协议的升级而可升级。

④ 互操作:支持多语言的交互。 -

常用数据序列化类型

2.2 自定义 bean 对象实现序列化接口

在企业开发中往往常用的基本序列化类型不能满足所有需求,比如在 Hadoop 框架内部传递一个 bean 对象,那么该对象就需要实现序列化接口。

具体实现 bean 对象序列化步骤如下 7 步。

- 实现 Writable 接口

- 反序列化时,需要反射调用空参构造函数,所以必须有空参构造

public FlowBean() {super();

}

- 重写序列化方法

@Override

public void write(DataOutput out) throws IOException {out.writeLong(upFlow);out.writeLong(downFlow);out.writeLong(sumFlow);

}

- 重写反序列化方法

@Override

public void readFields(DataInput in) throws IOException {upFlow = in.readLong();downFlow = in.readLong();sumFlow = in.readLong();

}

- 反序列化的顺序和序列化的顺序完全一致

- 要想把结果显示在文件中,需要重写 toString(),可用 ”\t” 分开,方便后续用。

- 如果需要将自定义的 bean 放在 key 中传输,则还需要实现 Comparable 接口,因为 MapReduce 框中的 Shuffle 过程要求对 key 必须能排序。

2.3 序列化案例实操

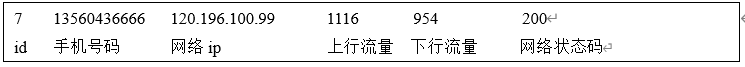

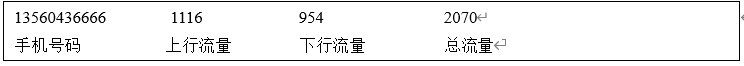

2.3.1 需求

统计每一个手机号耗费的总上行流量、下行流量、总流量

-

输入数据

phone_data.txt

1 13736230513 192.196.100.1 2481 24681 200

2 13846544121 192.196.100.2 264 0 200

3 13956435636 192.196.100.3 132 1512 200

4 13966251146 192.168.100.1 240 0 404

5 18271575951 192.168.100.2 1527 2106 200

6 18841884132 192.168.100.3 4116 1432 200

7 13590439668 192.168.100.4 1116 954 200

8 15910133277 192.168.100.5 3156 2936 200

9 13729199489 192.168.100.6 240 0 200

10 13630577991 192.168.100.7 6960 690 200

11 15043685818 192.168.100.8 3659 3538 200

12 15959002129 192.168.100.9 1938 180 500

13 13560439638 192.168.100.10 918 4938 200

14 13470253144 192.168.100.11 180 180 200

15 13682846555 192.168.100.12 1938 2910 200

16 13992314666 192.168.100.13 3008 3720 200

17 13509468723 192.168.100.14 7335 110349 404

18 18390173782 192.168.100.15 9531 2412 200

19 13975057813 192.168.100.16 11058 48243 200

20 13768778790 192.168.100.17 120 120 200

21 13568436656 192.168.100.18 2481 24681 200

22 13568436656 192.168.100.19 1116 954 200

- 输入数据格式

- 期望输出数据格式

2.3.2 需求分析

2.3.3 编写 MapReduce 程序

1.编写流量统计的 Bean 对象

package mr.flowsum;import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;import org.apache.hadoop.io.Writable;// 1 实现writable接口

public class FlowBean implements Writable {private long upFlow;private long downFlow;private long sumFlow;//2 反序列化时,需要反射调用空参构造函数,所以必须有public FlowBean() {super();}public FlowBean(long upFlow, long downFlow) {super();this.upFlow = upFlow;this.downFlow = downFlow;this.sumFlow = upFlow + downFlow;}//3 写序列化方法@Overridepublic void write(DataOutput out) throws IOException {out.writeLong(upFlow);out.writeLong(downFlow);out.writeLong(sumFlow);}//4 反序列化方法//5 反序列化方法读顺序必须和写序列化方法的写顺序必须一致@Overridepublic void readFields(DataInput in) throws IOException {this.upFlow = in.readLong();this.downFlow = in.readLong();this.sumFlow = in.readLong();}// 6 编写toString方法,方便后续打印到文本@Overridepublic String toString() {return upFlow + "\t" + downFlow + "\t" + sumFlow;}public long getUpFlow() {return upFlow;}public void setUpFlow(long upFlow) {this.upFlow = upFlow;}public long getDownFlow() {return downFlow;}public void setDownFlow(long downFlow) {this.downFlow = downFlow;}public long getSumFlow() {return sumFlow;}public void setSumFlow(long sumFlow) {this.sumFlow = sumFlow;}public void set(long downFlow, long upFlow) {this.downFlow = downFlow;this.upFlow = upFlow;this.sumFlow = downFlow + upFlow;}

}

- 编写 Mapper 类

package mr.flowsum;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class FlowCountMapper extends Mapper<LongWritable, Text, Text, FlowBean> {FlowBean v = new FlowBean();Text k = new Text();@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行// 1 13736230513 192.196.100.1 2481 24681 200String line = value.toString();// 2 切割字段String[] fields = line.split("\t");// 3 封装对象// 取出手机号码String phoneNum = fields[1];// 取出上行流量和下行流量long upFlow = Long.parseLong(fields[3]);long downFlow = Long.parseLong(fields[4]);k.set(phoneNum);v.set(downFlow, upFlow);// 4 写出context.write(k, v);}

}

- 编写 Reducer 类

package mr.flowsum;import java.io.IOException;import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class FlowCountReducer extends Reducer<Text, FlowBean, Text, FlowBean> {@Overrideprotected void reduce(Text key, Iterable<FlowBean> values, Context context) throws IOException, InterruptedException {long sum_upFlow = 0;long sum_downFlow = 0;// 1 遍历所用bean,将其中的上行流量,下行流量分别累加for (FlowBean flowBean : values) {sum_upFlow += flowBean.getUpFlow();sum_downFlow += flowBean.getDownFlow();}// 2 封装对象FlowBean v = new FlowBean(sum_upFlow, sum_downFlow);// 3 写出context.write(key, v);}

}

- 编写 Driver 驱动类

package mr.flowsum;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class FlowSumDriver {public static void main(String[] args) throws IllegalArgumentException, IOException, ClassNotFoundException, InterruptedException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/inputflow.txt", "f:/0/output/flowSum"};// 1 获取配置信息,或者job对象实例Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 2 指定本程序的jar包所在的本地路径job.setJarByClass(FlowSumDriver.class);// 3 指定本业务job要使用的mapper/Reducer业务类job.setMapperClass(FlowCountMapper.class);job.setReducerClass(FlowCountReducer.class);// 4 指定mapper输出数据的kv类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(FlowBean.class);// 5 指定最终输出的数据的kv类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(FlowBean.class);// 6 指定job的输入原始文件所在目录FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 7 将job中配置的相关参数,以及job所用的java类所在的jar包, 提交给yarn去运行boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

3. MapReduce 框架原理

3.1 InputFormat 数据输入

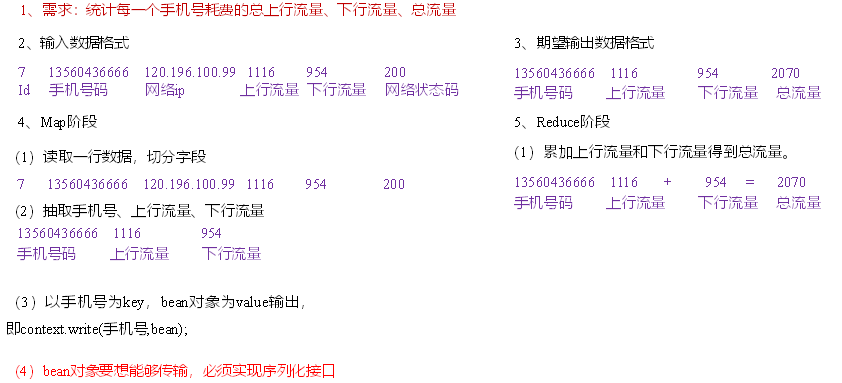

3.1.1 切片与 MapTask 并行度决定机制

MapTask 的并行度决定 Map 阶段的任务处理并发度,进而影响到整个 Job 的处理速度。

数据块: Block 是 HDFS 物理上把数据分成一块一块。

数据切片: 数据切片只是在逻辑上对输入进行分片,并不会在磁盘上将其切分成片进行存储。

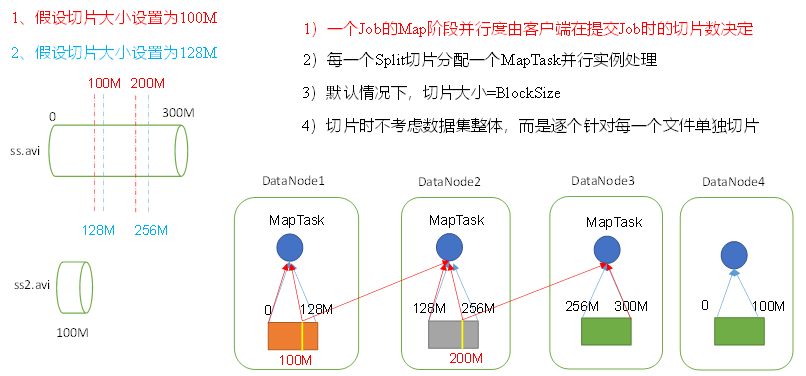

3.1.2 Job 提交流程源码解析

3.1.3 FileInputFormat 切片源码解析

-

程序先找到你数据存储的目录。

-

开始遍历处理(规划切片)目录下的每一个文件

-

遍历第一个文件 ss txt

① 获取文件大小 fs.sizeOf(ss.txt)

② 计算切片大小

computeSplitSize(Math.max(minSize,Math.min(maxSize, blocksize)) ) = blocksize = 128M

③ 默认情况下,切片大小 = blocksize

④ 开始切,形成第1个切片: ss.txt——0: 128M;第2个切片 ss.txt——128:256M;第3个切片 ss .txt——256M: 300M

(每次切片时,都要判断切完剩下的部分是否大于块的 1.1 倍,不大于 1.1 倍就划分一块切片)

⑤ 将切片信息写到一个切片规划文件中

⑥ 整个切片的核心过程在 getSplit0 方法中完成

⑦ InputSplit 只记录了切片的元数据信息,比如起始位置、长度以及所在的节点列表等。 -

提交切片规划文件到 YARN上,YARN 上的 MrAppMaster 就可以根据切片规划文件计算开启 Map Task 个数。

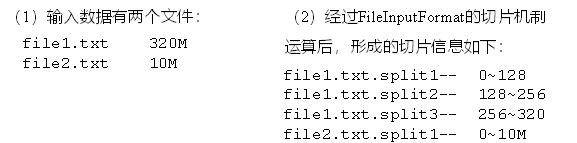

3.1.4 FileInputFormat 切片机制

-

切片机制

① 简单地按照文件的内容长度进行切片

② 切片大小,默认等于 Block 大小

③ 切片时不考虑数据集整体,而是逐个针对每一 个文件单独切片 -

案例分析

-

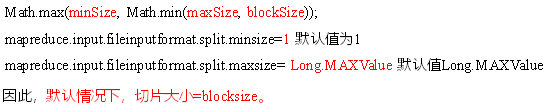

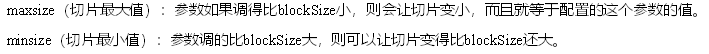

切片大小参数配置

① 源码中计算切片大小的公式

② 切片大小设置

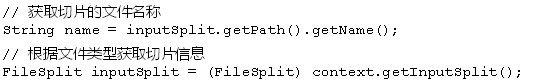

③ 获取切片信息 API

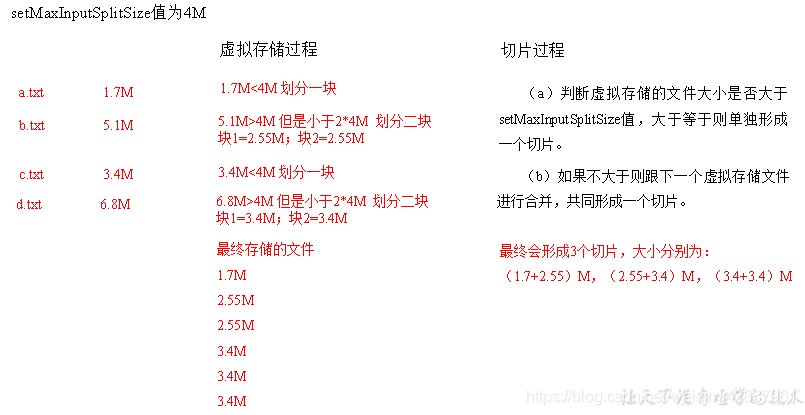

3.1.5 CombineTextInputFormat 切片机制

框架默认的 TextInputFormat 切片机制是对任务按文件规划切片,不管文件多小,都会是一个单独的切片,都会交给一个 MapTask,这样如果有大量小文件,就会产生大量的 MapTask,处理效率极其低下。

-

应用场景

CombineTextInputFormat 用于小文件过多的场景,它可以将多个小文件从逻辑上规划到一个切片中,这样,多个小文件就可以交给一个 MapTask 处理。

-

虚拟存储切片最大值设置

CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);// 4m

注意:虚拟存储切片最大值设置最好根据实际的小文件大小情况来设置具体的值。

-

切片机制

-

案例实操

将输入的 4 个小文件合并成一个切片统一处理。

① 不做任何处理,运行之前 WordCount 案例程序,观察切片个数。

② 在 WordCountDriver 中增加如下代码,运行程序,并观察运行的切片个数

// 如果不设置InputFormat,它默认用的是TextInputFormat.class

job.setInputFormatClass(CombineTextInputFormat.class);//虚拟存储切片最大值设置4m

CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);

3.1.6 FileInputFormat 实现类

FileInputFormat 常见的接口实现类包括:TextInputFormat、KeyValueTextInputFormat.、NLineInputFormat、CombineTextInputFormat、SequenceFileInputFormat 和自定义 InputFormat 等。

-

TextInputFormat

TextInputFormat 是默认的 FileInputFormat 实现类。按行读取每条记录。键是存储该行在整个文件中的起始字节偏移量,LongWritable 类型。 值是这行的内容,不包括任何行终止符(换行符和回车符),Text 类型。

以下是一 个示例,比如,一个分片包含了如下 4 条文本记录。

Rich learning form

Intelligent learning engine

Learning more convenient

From the real demand for more close to the enterprise

每条记录表示为以下键/值对:

(0, Rich learning fo rm)

(20, Inte lligent learning engine)

(49, Learning more convenient)

(75, From the real demand for more close to the enterprise)

-

KeyValueTextInputFormat

每一行均为一条记录,被分隔符分割为 key,value。可以通过在驱动类中设置

conf.set(KeyValueLineRecordReader.KEY _VALUE_SEPERATOR,“\t"),来设定分隔符。 默认分隔符是tab (\t) 。以下是一个示例, 输入是一个包含 4 条记录的分片。其中 一> 表示一个(水平方向的)制表符。

line1 一>Rich learning form

line2 一>Intelligent learning engine

line3 一>Learning more convenient

line4 一>From the real demand for more close to the enterprise

每条记录表示为以下键/值对:此时的键是每行排在制表符之前的 Text 序列。

(line1, Rich learning form)

(line2, Intelligent learning engine)

(line3, Learning more convenient)

(line4, From the real demand for more close to the enterprise)

-

NLineInputFormat

如果使用 NLineInputFormat,代表每个 map 进程处理的 InputSplit 不再按 Block 块去划分,而是按

NLineInputFormat 指定的行数 N 来划分。即输入文件的总行数/N = 切片数,如果不整除,切片数 = 商+1。以下是一个示例,仍然以上面的 4 行输入为例。

Rich learning form

Intelligent learning engine

Learning more convenient

From the real demand for more close to the enterprise

例如,如果 N 是 2,则每个输入分片包含两行。开启 2 个MapTask。

(0,Rich learning form)

(20. Intelligent learning engine)

另一个 mapper 则收到后两行:

(49,Learning more convenient)

(75, From the real demand for more close to the enterprise)

这里的键和值与 TextInputFormat 生成的一样。

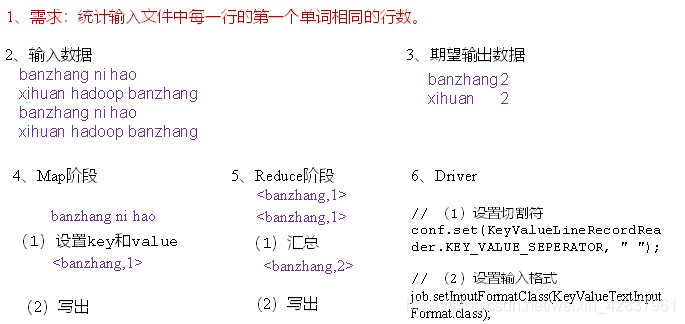

3.1.7 KeyValueTextInputFormat 使用案例

-

需求

统计输入文件中每一行的第一个单词相同的行数。

① 输入数据

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang

② 期望结果数据

banzhang 2

xihuan 2

-

需求分析

-

代码实现

① 编写 Mapper 类

package mr.kv;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class KVTextMapper extends Mapper<Text, Text, Text, IntWritable> {// 1 设置valueIntWritable v = new IntWritable(1);@Overrideprotected void map(Text key, Text value, Context context) throws IOException, InterruptedException {// banzhang ni hao// 2 写出context.write(key, v);}

}

② 编写 Reducer 类

package mr.kv;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class KVTextMapper extends Mapper<Text, Text, Text, IntWritable> {// 1 设置valueIntWritable v = new IntWritable(1);@Overrideprotected void map(Text key, Text value, Context context) throws IOException, InterruptedException {// banzhang ni hao// 2 写出context.write(key, v);}

}

③ 编写 Driver 类

package mr.kv;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.input.KeyValueLineRecordReader;

import org.apache.hadoop.mapreduce.lib.input.KeyValueTextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class KVTextDriver {public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/kv.txt", "f:/0/output/KV"};Configuration conf = new Configuration();// 设置切割符conf.set(KeyValueLineRecordReader.KEY_VALUE_SEPERATOR, " ");// 1 获取job对象Job job = Job.getInstance(conf);// 2 设置jar包位置,关联mapper和reducerjob.setJarByClass(KVTextDriver.class);job.setMapperClass(KVTextMapper.class);job.setReducerClass(KVTextReducer.class);// 3 设置map输出kv类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(IntWritable.class);// 4 设置最终输出kv类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(IntWritable.class);// 5 设置输入输出数据路径FileInputFormat.setInputPaths(job, new Path(args[0]));// 设置输入格式job.setInputFormatClass(KeyValueTextInputFormat.class);// 6 设置输出数据路径FileOutputFormat.setOutputPath(job, new Path(args[1]));// 7 提交jobjob.waitForCompletion(true);}

}

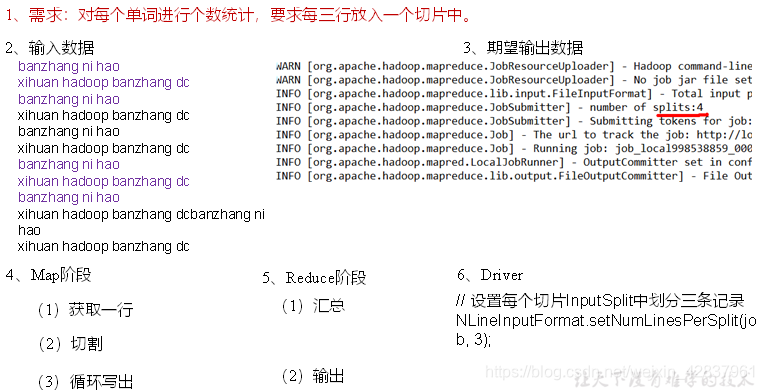

3.1.8 NLineInputFormat 使用案例

-

需求

对每个单词进行个数统计,要求根据每个输入文件的行数来规定输出多少个切片。此案例要求每三行放入一个切片中。

① 输入数据

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang banzhang ni hao

xihuan hadoop banzhang

-

需求分析

-

代码实现

① 编写 Mapper 类

package mr.nline;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class NLineMapper extends Mapper<LongWritable, Text, Text, IntWritable> {private Text k = new Text();private IntWritable v = new IntWritable(1);@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行String line = value.toString();// 2 切割String[] splited = line.split(" ");// 3 循环写出for (int i = 0; i < splited.length; i++) {k.set(splited[i]);context.write(k, v);}}

}

② 编写 Reducer 类

package mr.nline;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class NLineReducer extends Reducer<Text, IntWritable, Text, IntWritable> {IntWritable v = new IntWritable();@Overrideprotected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {int sum = 0;// 1 汇总for (IntWritable value : values) {sum += value.get();}v.set(sum);// 2 输出context.write(key, v);}

}

③ 编写 Driver 类

package mr.nline;import java.io.IOException;

import java.net.URISyntaxException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.input.NLineInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class NLineDriver {public static void main(String[] args) throws IOException, URISyntaxException, ClassNotFoundException, InterruptedException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/nline.txt", "f:/0/output/NLine"};// 1 获取job对象Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 7设置每个切片InputSplit中划分三条记录NLineInputFormat.setNumLinesPerSplit(job, 3);// 8使用NLineInputFormat处理记录数job.setInputFormatClass(NLineInputFormat.class);// 2设置jar包位置,关联mapper和reducerjob.setJarByClass(NLineDriver.class);job.setMapperClass(NLineMapper.class);job.setReducerClass(NLineReducer.class);// 3设置map输出kv类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(IntWritable.class);// 4设置最终输出kv类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(IntWritable.class);// 5设置输入输出数据路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 6提交jobjob.waitForCompletion(true);}

}

3.1.9 自定义 InputFormat 使用案例

在企业开发中,Hadoop 框架自带的 InputFormat 类型不能满足所有应用场景,需要自定义 InputFomat 来解决实际问题。

自定义 InputFormat 步骤如下:

① 自定义一个类继承 FileInputFormat。

② 改写 RecordReader,实现一次读取一个完整文件封装为 KV。

③ 在输出时使用 SequenceFileOutPutFormat 输出合并文件。

无论 HDFS 还是 MapReduce,在处理小文件时效率都非常低,但又难免面临处理大量小文件的场景,此时,就需要有相应解决方案。可以自定义 InputFormat 实现小文件的合并。

-

需求

将多个小文件合并成一个 SequenceFile 文件(SequenceFile 文件是 Hadoop 用来存储二进制形式的 key-value 对的文件格式),SequenceFile 里面存储着多个文件,存储的形式为文件路径+名称为 key,文件内容为 value。

① 输入数据

one.txt

yongpeng weidong weinan

sanfeng luozong xiaoming

two.txt

longlong fanfan

mazong kailun yuhang yixin

longlong fanfan

mazong kailun yuhang yixin

three.txt

shuaige changmo zhenqiang

dongli lingu xuanxuan

-

需求分析

① 自定义一个类继承 FileInputFornat

(1) 重写 isSplitable() 方法,返回 false 不可切割

(2) 重写 createRecordReader(),创建自定义的 RecordReader 对象,并初始化② 改写 RecordReader, 实现一次读取一个完整文件封装为 KV

(1) 采用 IO 流一次读取一个文件输出到 value 中,因为设置了不可切片,最终把所有文件都封装到了 value 中

(2) 获取文件路径信息+名称,并设置 key③ 设置 Driver

// (1) 设置输入的input Format

job.setInputFormatClass(WholeFileInputformat.class);

// (2) 设置输出的outputFormat

job.setoutputFormatClass(SequenceFileOutputFormat.class);

-

程序实现

① 自定义 InputFromat

package mr.inputformat;import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.ByteWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.InputSplit;

import org.apache.hadoop.mapreduce.JobContext;

import org.apache.hadoop.mapreduce.RecordReader;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;import java.io.IOException;public class WholeFileInputFormat extends FileInputFormat<Text, ByteWritable> {@Overrideprotected boolean isSplitable(JobContext context, Path filename) {return false;}@Overridepublic RecordReader createRecordReader(InputSplit split, TaskAttemptContext context) throws IOException, InterruptedException {WholeRecordReader recordReader = new WholeRecordReader();recordReader.initialize(split, context);return recordReader;}

}

② 自定义 RecordReader 类

package mr.inputformat;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.InputSplit;

import org.apache.hadoop.mapreduce.RecordReader;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.input.FileSplit;import java.io.IOException;public class WholeRecordReader extends RecordReader {private Configuration configuration;private FileSplit split;private boolean isProgress = true;private BytesWritable v = new BytesWritable();private Text k = new Text();@Overridepublic void initialize(InputSplit split, TaskAttemptContext context) throws IOException, InterruptedException {this.split = (FileSplit) split;configuration = context.getConfiguration();}@Overridepublic boolean nextKeyValue() throws IOException, InterruptedException {if (isProgress) {byte[] buf = new byte[(int) split.getLength()];FileSystem fs = null;FSDataInputStream fis = null;// 1 获取fs对象Path path = split.getPath();fs = path.getFileSystem(configuration);// 2 获取输入流fis = fs.open(path);// 3 拷贝IOUtils.readFully(fis, buf, 0, buf.length);// 4 封装vv.set(buf, 0, buf.length);// 5 封装kk.set(path.toString());// 6 关闭资源IOUtils.closeStream(fis);isProgress = false;return true;}return false;}@Overridepublic Object getCurrentKey() throws IOException, InterruptedException {return k;}@Overridepublic Object getCurrentValue() throws IOException, InterruptedException {return v;}@Overridepublic float getProgress() throws IOException, InterruptedException {return 0;}@Overridepublic void close() throws IOException {}

}

③ 编写 SequenceFileMapper 类

package mr.inputformat;import java.io.IOException;import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class SequenceFileMapper extends Mapper<Text, BytesWritable, Text, BytesWritable> {@Overrideprotected void map(Text key, BytesWritable value, Context context) throws IOException, InterruptedException {context.write(key, value);}

}

④ 编写 SequenceFileReducer 类

package mr.inputformat;import java.io.IOException;import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class SequenceFileReducer extends Reducer<Text, BytesWritable, Text, BytesWritable> {@Overrideprotected void reduce(Text key, Iterable<BytesWritable> values, Context context) throws IOException, InterruptedException {for (BytesWritable value : values) {context.write(key, value);}}

}

⑤ 编写 SequenceFileDriver 类

package mr.inputformat;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.lib.output.SequenceFileOutputFormat;public class SequenceFileDriver {public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/inputFormat", "f:/0/output/inputFormat"};// 1 获取job对象Configuration conf = new Configuration();Job job = Job.getInstance(conf);// 2 设置jar包存储位置、关联自定义的mapper和reducerjob.setJarByClass(SequenceFileDriver.class);job.setMapperClass(SequenceFileMapper.class);job.setReducerClass(SequenceFileReducer.class);// 7设置输入的inputFormatjob.setInputFormatClass(WholeFileInputFormat.class);// 8设置输出的outputFormatjob.setOutputFormatClass(SequenceFileOutputFormat.class);// 3 设置map输出端的kv类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(BytesWritable.class);// 4 设置最终输出端的kv类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(BytesWritable.class);// 5 设置输入输出路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 6 提交jobboolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

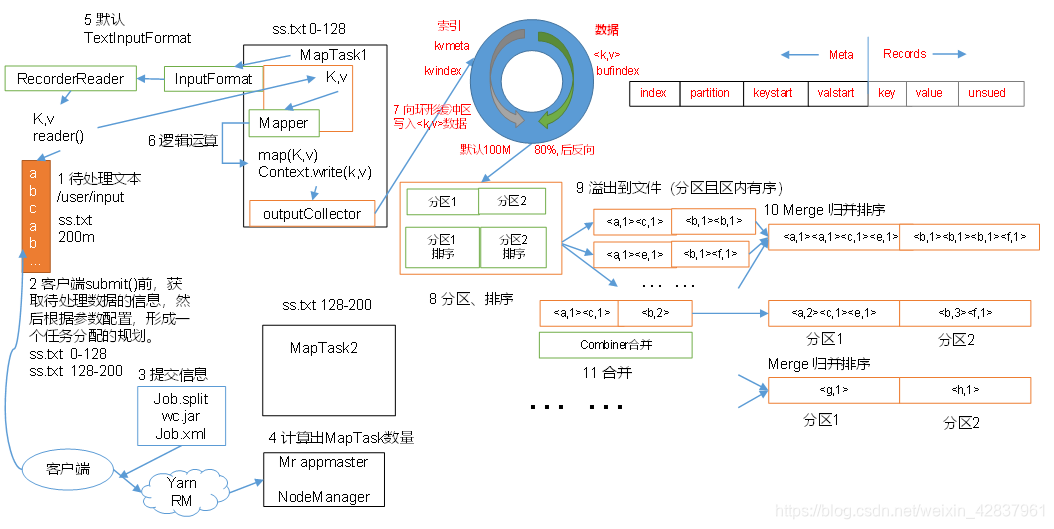

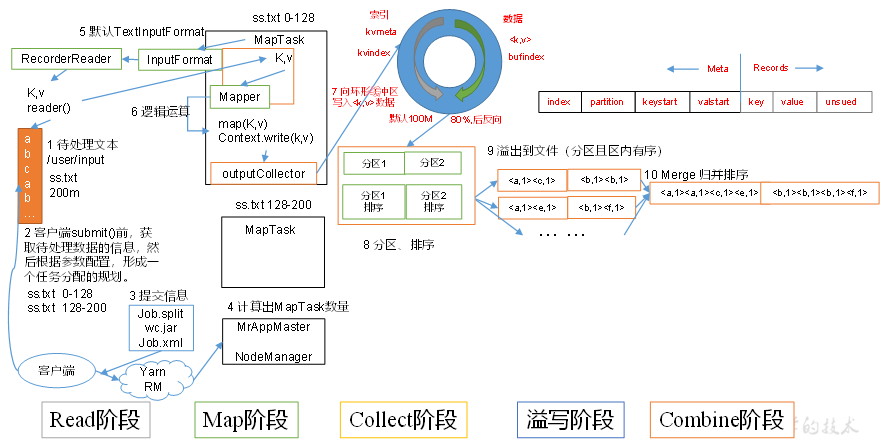

3.2 MapReduce 工作流程

- 流程示意图

3.3 Shuffle 机制

3.3.1 Shuffle 机制

Map 方法之后,Reduce 方法之前的数据处理过程称之为 Shuffle。

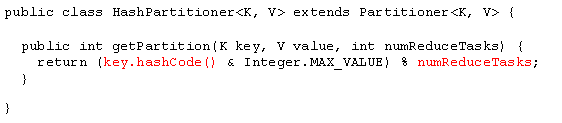

3.3.2 Partition 分区

-

问题引出

要求将统计结果按照条件输出到不同文件中(分区)。比如:将统计结果按照手机归属地不同省份输出到不同文件中(分区)。

-

默认 partition 分区

默认分区是根据 key 的 hashCode 对 ReduceTasks 个数取模得到的。用户没法控制哪个 key 存储到哪个分区。

-

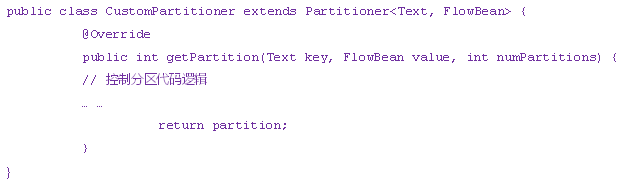

自定义 partition 步骤

① 自定义类继承 Partitioner,重写 getParttion0 方法

② 在 Job 驱动中,设置自定义 Partitioner

job.setParttionerClass(CustomPartitioner.class);

③ 自定义 Parition 后,要根据自定义 Partitioner 的逻辑设置相应数量的 ReduceTask

job.setNJumReduceTask(5);

-

分区总结

① 如果 ReduceTask 的数量 > getPartition() 的结果数,则会多产生几个空的输出文件 pat-000xx;

② 如果 1 < ReduceTask 的数量 < getParttion() 的结果数,则有一部分分区数据无处安放,会 Exception;

③ 如果 ReduceTask 的数量 = 1,则不管 MapTask 端输出多少个分区文件,最终结果都交给这一个 ReduceTask,最终也就只会产生一个结果文件 part-00000;

④ 分区号必须从零开始,逐一累加。

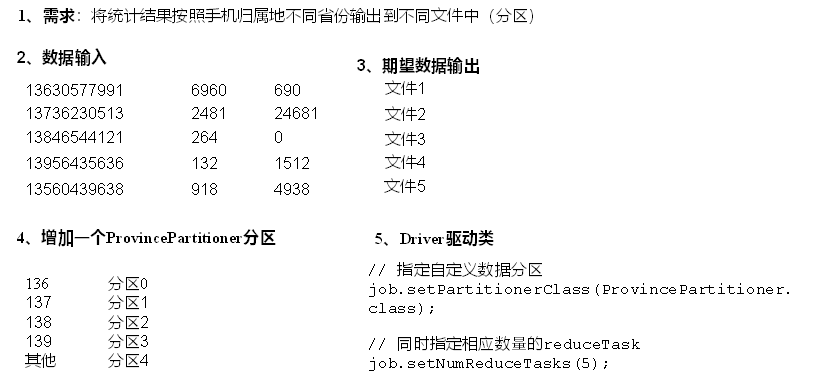

3.3.3 Partition 分区案例实操

-

需求

将统计结果按照手机归属地不同省份输出到不同文件中(分区)

① 输入数据

phone_data.txt

1 13736230513 192.196.100.1 2481 24681 200

2 13846544121 192.196.100.2 264 0 200

3 13956435636 192.196.100.3 132 1512 200

4 13966251146 192.168.100.1 240 0 404

5 18271575951 192.168.100.2 1527 2106 200

6 18841884132 192.168.100.3 4116 1432 200

7 13590439668 192.168.100.4 1116 954 200

8 15910133277 192.168.100.5 3156 2936 200

9 13729199489 192.168.100.6 240 0 200

10 13630577991 192.168.100.7 6960 690 200

11 15043685818 192.168.100.8 3659 3538 200

12 15959002129 192.168.100.9 1938 180 500

13 13560439638 192.168.100.10 918 4938 200

14 13470253144 192.168.100.11 180 180 200

15 13682846555 192.168.100.12 1938 2910 200

16 13992314666 192.168.100.13 3008 3720 200

17 13509468723 192.168.100.14 7335 110349 404

18 18390173782 192.168.100.15 9531 2412 200

19 13975057813 192.168.100.16 11058 48243 200

20 13768778790 192.168.100.17 120 120 200

21 13568436656 192.168.100.18 2481 24681 200

22 13568436656 192.168.100.19 1116 954 200

② 期望输出数据

手机号 136、137、138、139 开头都分别放到一个独立的 4 个文件中,其他开头的放到一个文件中。

-

需求分析

-

代码实现

① 在案例 2.3 的基础上,增加一个分区类 ProvincePartitioner

package mr.flowsum;import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner;public class ProvincePartitioner extends Partitioner<Text, FlowBean> {@Overridepublic int getPartition(Text key, FlowBean value, int numPartitions) {// 1 获取电话号码的前三位String preNum = key.toString().substring(0, 3);int partition = 4;// 2 判断是哪个省if ("136".equals(preNum)) {partition = 0;} else if ("137".equals(preNum)) {partition = 1;} else if ("138".equals(preNum)) {partition = 2;} else if ("139".equals(preNum)) {partition = 3;}return partition;}

}

② 在驱动函数中增加自定义数据分区设置和 ReduceTask 设置

// 8 指定自定义数据分区

job.setPartitionerClass(ProvincePartitioner.class);// 9 同时指定相应数量的reduce task

job.setNumReduceTasks(5);

3.3.4 WritableComparable 排序

-

排序概述

排序是 MapReducet 框架中最重要的操作之一。

Mapask 和 ReduceTask 均会对数据按照 key 进行排序。该操作属于 Hadoop 的默认行为。任何应用程序中的数据均会被排序,而不管逻辑上是否需要。

默认排序是按照字典顺序排序,且实现该排序的方法是快速排序。

对于 MapTask,它会将处理的结果暂时放到环形缓冲区中,当环形缓冲区使用率达到一定阈值后,再对缓冲区中的数据进行一次快速排序,并将这些有序数据益写到磁盘上,而当数据处理完毕后,它会对磁盘上所有文件进行归并排序。

对于 ReduceTask,它从每个 MapTask 上远程拷贝相应的数据文件,如果文件大小超过一定阈值,则溢写磁盘上,否则存储在内存中。如果磁盘上文件数目达到一定阈值, 则进行一次归并排序以生成一个更大文件,如果内存中文件大小或者数目超过一定阈值,则进行一次合并后将数据溢写到磁盘上。当所有数据拷贝完毕后,ReduceTask 统一对内存和磁盘上的所有数据进行一次归并排序。

-

排序的分类

① 部分排序

MapReduce 根据输入记录的键对数据集排序。保证输出的每个文件内部有序。

② 全排序

最终输出结果只有一个文件,且文件内部有序。实现方式是只设置一个 ReduceTask。但该方法在处理大型文件时效率极低,因为一台机器处理所有文件,完全丧失了 MapReduce 所提供的并行架构。

③ 辅助排序: (GroupingComparator 分组)

在 Reduce 端对 key 进行分组。应用于在接收的 key 为 bean 对象时,想让一个或几个字段相同(全部字段比较不相同)的 key 进入到同一个 reduce 方法时,可以采用分组排序。

④ 二次排序

在自定义排序过程中,如果 compareTo 中的判断条件为两个即为二次排序。

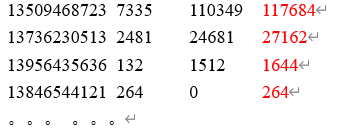

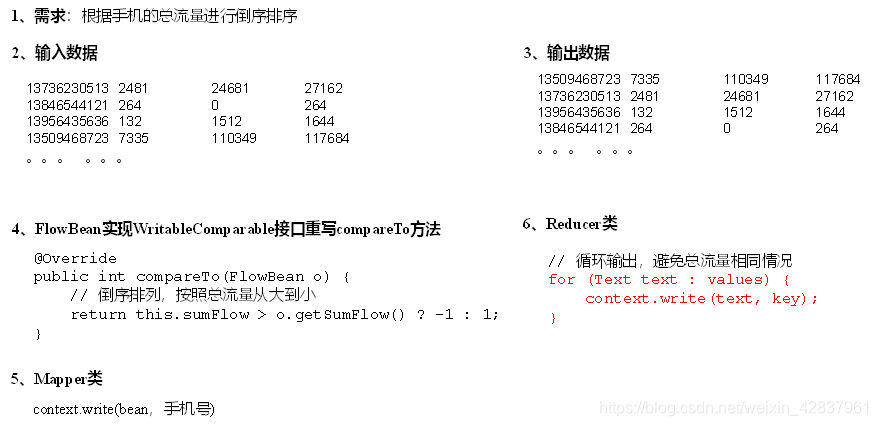

3.3.5 全排序案例实操

-

需求

根据案例 2.3 产生的结果再次对总流量进行排序。

① 输入数据:第一次处理后的数据 part-r-00000

13470253144 180 180 360

13509468723 7335 110349 117684

13560439638 918 4938 5856

13568436656 3597 25635 29232

13590439668 1116 954 2070

13630577991 6960 690 7650

13682846555 1938 2910 4848

13729199489 240 0 240

13736230513 2481 24681 27162

13768778790 120 120 240

13846544121 264 0 264

13956435636 132 1512 1644

13966251146 240 0 240

13975057813 11058 48243 59301

13992314666 3008 3720 6728

15043685818 3659 3538 7197

15910133277 3156 2936 6092

15959002129 1938 180 2118

18271575951 1527 2106 3633

18390173782 9531 2412 11943

18841884132 4116 1432 5548

② 期望输出数据

2. 需求分析

-

代码实现

① 编写 FlowBean 对象

package mr.sort;import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;import org.apache.hadoop.io.WritableComparable;public class FlowBean implements WritableComparable<FlowBean> {private long upFlow;private long downFlow;private long sumFlow;// 反序列化时,需要反射调用空参构造函数,所以必须有public FlowBean() {super();}public FlowBean(long upFlow, long downFlow) {super();this.upFlow = upFlow;this.downFlow = downFlow;this.sumFlow = upFlow + downFlow;}public void set(long upFlow, long downFlow) {this.upFlow = upFlow;this.downFlow = downFlow;this.sumFlow = upFlow + downFlow;}public long getSumFlow() {return sumFlow;}public void setSumFlow(long sumFlow) {this.sumFlow = sumFlow;}public long getUpFlow() {return upFlow;}public void setUpFlow(long upFlow) {this.upFlow = upFlow;}public long getDownFlow() {return downFlow;}public void setDownFlow(long downFlow) {this.downFlow = downFlow;}/*** 序列化方法** @param out* @throws IOException*/@Overridepublic void write(DataOutput out) throws IOException {out.writeLong(upFlow);out.writeLong(downFlow);out.writeLong(sumFlow);}/*** 反序列化方法 注意反序列化的顺序和序列化的顺序完全一致** @param in* @throws IOException*/@Overridepublic void readFields(DataInput in) throws IOException {upFlow = in.readLong();downFlow = in.readLong();sumFlow = in.readLong();}@Overridepublic String toString() {return upFlow + "\t" + downFlow + "\t" + sumFlow;}@Overridepublic int compareTo(FlowBean bean) {int result;// 按照总流量大小,倒序排列if (sumFlow > bean.getSumFlow()) {result = -1;} else if (sumFlow < bean.getSumFlow()) {result = 1;} else {result = 0;}return result;}

}

② 编写 Mapper 类

package mr.sort;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class FlowCountSortMapper extends Mapper<LongWritable, Text, FlowBean, Text> {FlowBean bean = new FlowBean();Text v = new Text();@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行String line = value.toString();// 2 截取String[] fields = line.split("\t");// 3 封装对象String phoneNbr = fields[0];long upFlow = Long.parseLong(fields[1]);long downFlow = Long.parseLong(fields[2]);bean.set(upFlow, downFlow);v.set(phoneNbr);// 4 输出context.write(bean, v);}

}

③ 编写 Reducer 类

package mr.sort;import java.io.IOException;import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class FlowCountSortReducer extends Reducer<FlowBean, Text, Text, FlowBean> {@Overrideprotected void reduce(FlowBean key, Iterable<Text> values, Context context) throws IOException, InterruptedException {// 循环输出,避免总流量相同情况for (Text text : values) {context.write(text, key);}}

}

④ 编写 Driver 类

package mr.sort;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class FlowCountSortDriver {public static void main(String[] args) throws ClassNotFoundException, IOException, InterruptedException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/output/flowSum", "f:/0/output/sort"};// 1 获取配置信息,或者job对象实例Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 2 指定本程序的jar包所在的本地路径job.setJarByClass(FlowCountSortDriver.class);// 3 指定本业务job要使用的mapper/Reducer业务类job.setMapperClass(FlowCountSortMapper.class);job.setReducerClass(FlowCountSortReducer.class);// 4 指定mapper输出数据的kv类型job.setMapOutputKeyClass(FlowBean.class);job.setMapOutputValueClass(Text.class);// 5 指定最终输出的数据的kv类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(FlowBean.class);// 6 指定job的输入原始文件所在目录FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 7 将job中配置的相关参数,以及job所用的java类所在的jar包, 提交给yarn去运行boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

3.3.6 区内排序案例实操

-

需求

要求每个省份手机号输出的文件中按照总流量内部排序。

-

需求分析

基于前一个需求,增加自定义分区类,分区按照省份手机号设置。

-

代码实现

① 增加自定义分区类

package mr.sort;import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner;public class ProvincePartitioner extends Partitioner<FlowBean, Text> {@Overridepublic int getPartition(FlowBean key, Text value, int numPartitions) {// 1 获取手机号码前三位String preNum = value.toString().substring(0, 3);int partition = 4;// 2 根据手机号归属地设置分区if ("136".equals(preNum)) {partition = 0;}else if ("137".equals(preNum)) {partition = 1;}else if ("138".equals(preNum)) {partition = 2;}else if ("139".equals(preNum)) {partition = 3;}return partition;}

}

② 在驱动类中添加分区类

// 加载自定义分区类

job.setPartitionerClass(ProvincePartitioner.class);// 设置Reducetask个数

job.setNumReduceTasks(5);

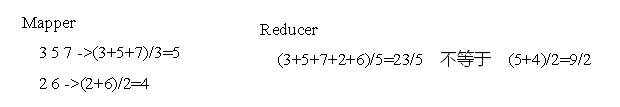

3.3.7 Combiner 合并

-

Combiner 是 MR 程序中 Mapper 和 Reducer 之外的一种组件。

-

Combiner 组件的父类就是 Reducer。

-

Combiner 和 Reducer 的区别在于运行的位置

① Combiner 是在每一个 MapTask 所在的节点运行

② Reducer 是接收全局所有 Mapper 的输出结果 -

Combiner 的意义就是对每一个 MapTask 的输出进行局部汇总,以减小网络传输量。

-

Combiner 能够应用的前提是不能影响最终的业务逻辑,而且,Combiner 的输出 kv 应该跟 Reducer 的输入 kv 类型要对应起来。

-

自定义 Combiner 实现步骤

① 自定义一个 Combiner 继承 Reducer,重写 Reduce 方法

② 在 Job 驱动类中设置:

job.setCombinerClass(WordcountCombiner.class);

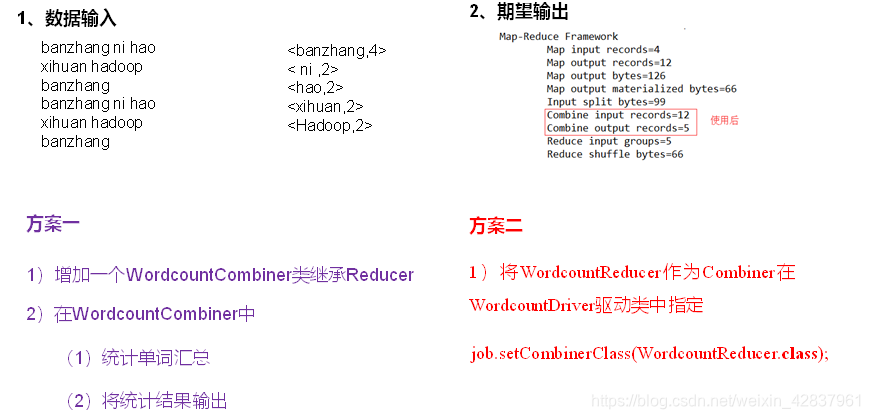

3.3.8 Combiner 合并案例实操

-

需求

统计过程中对每一个 MapTask 的输出进行局部汇总,以减小网络传输量即采用 Combiner 功能。

① 输入数据

hello.txt

banzhang ni hao

xihuan hadoop banzhang

banzhang ni hao

xihuan hadoop banzhang

-

需求分析

-

代码实现 - 方案一

① 增加一个 WordCountCombiner 类继承 Reducer

package mr.wordcount;import java.io.IOException;import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class WordCountCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {IntWritable v = new IntWritable();@Overrideprotected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {// 1 汇总int sum = 0;for (IntWritable value : values) {sum += value.get();}v.set(sum);// 2 写出context.write(key, v);}

}

② 在 WordCountDriver 驱动类中指定 Combiner

// 指定需要使用combiner,以及用哪个类作为combiner的逻辑

job.setCombinerClass(WordCountCombiner.class);

-

代码实现 - 方案二

将 WordCountReducer 作为 Combiner 在 WordcountDriver 驱动类中指定

// 指定需要使用Combiner,以及用哪个类作为Combiner的逻辑

job.setCombinerClass(WordCountReducer.class);

3.3.9 分组(辅助)排序

对 Reduce 阶段的数据根据某一个或几个字段进行分组。

分组排序步骤:

- 自定义类继承 WritableComparator

- 重写 compare() 方法

@Override

public int compare(WritableComparable a, WritableComparable b) {// 比较的业务逻辑return result;

}

- 创建一个构造将比较对象的类传给父类

protected OrderGroupingComparator() {super(OrderBean.class, true);

}

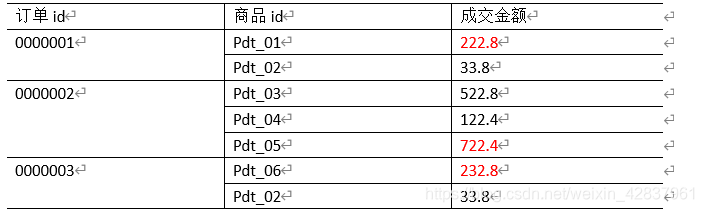

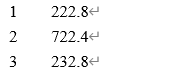

3.3.10 分组案例实操

-

需求

有如下订单数据

现在需要求出每一个订单中最贵的商品。① 输入数据

GroupingComparator.txt

0000001 Pdt_01 222.8

0000002 Pdt_05 722.4

0000001 Pdt_02 33.8

0000003 Pdt_06 232.8

0000003 Pdt_02 33.8

0000002 Pdt_03 522.8

0000002 Pdt_04 122.4

② 期望输出数据

-

需求分析

-

代码实现

① 定义订单信息 OrderBean 类

package mr.order;import org.apache.hadoop.io.WritableComparable;import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;public class OrderBean implements WritableComparable<OrderBean> {private int order_id; // 订单id号private double price; // 价格public OrderBean() {super();}public OrderBean(int order_id, double price) {this.order_id = order_id;this.price = price;}// 二次排序@Overridepublic int compareTo(OrderBean o) {int result;if (order_id != o.getOrder_id()) {result = order_id > o.getOrder_id() ? 1 : -1;} else {// 价格倒序排序result = price > o.getPrice() ? -1 : 1;}return result;}@Overridepublic void write(DataOutput out) throws IOException {out.writeInt(order_id);out.writeDouble(price);}@Overridepublic void readFields(DataInput in) throws IOException {order_id = in.readInt();price = in.readDouble();}@Overridepublic String toString() {return order_id + "\t" + price;}public int getOrder_id() {return order_id;}public void setOrder_id(int order_id) {this.order_id = order_id;}public double getPrice() {return price;}public void setPrice(double price) {this.price = price;}

}

② 编写OrderMapper 类

package mr.order;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class OrderMapper extends Mapper<LongWritable, Text, OrderBean, NullWritable> {OrderBean k = new OrderBean();@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行String line = value.toString();// 2 截取String[] fields = line.split("\t");// 3 封装对象k.setOrder_id(Integer.parseInt(fields[0]));k.setPrice(Double.parseDouble(fields[2]));// 4 写出context.write(k, NullWritable.get());}

}

③ 编写 OrderGroupingComparator 类

package mr.order;import org.apache.hadoop.io.WritableComparable;

import org.apache.hadoop.io.WritableComparator;public class OrderGroupingComparator extends WritableComparator {protected OrderGroupingComparator() {super(OrderBean.class, true);}@Overridepublic int compare(WritableComparable a, WritableComparable b) {OrderBean aBean = (OrderBean) a;OrderBean bBean = (OrderBean) b;int result;if (aBean.getOrder_id() > bBean.getOrder_id()) {result = 1;} else if (aBean.getOrder_id() < bBean.getOrder_id()) {result = -1;} else {result = 0;}return result;}

}

④ 编写 OrderReducer 类

package mr.order;import java.io.IOException;import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.mapreduce.Reducer;public class OrderReducer extends Reducer<OrderBean, NullWritable, OrderBean, NullWritable> {@Overrideprotected void reduce(OrderBean key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {context.write(key, NullWritable.get());}

}

⑤ 编写 OrderDriver 类

package mr.order;import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class OrderDriver {public static void main(String[] args) throws Exception, IOException {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/GroupingComparator.txt", "f:/0/output/OrderSort"};// 1 获取配置信息Configuration conf = new Configuration();Job job = Job.getInstance(conf);// 2 设置jar包加载路径job.setJarByClass(OrderDriver.class);// 3 加载map/reduce类job.setMapperClass(OrderMapper.class);job.setReducerClass(OrderReducer.class);// 4 设置map输出数据key和value类型job.setMapOutputKeyClass(OrderBean.class);job.setMapOutputValueClass(NullWritable.class);// 5 设置最终输出数据的key和value类型job.setOutputKeyClass(OrderBean.class);job.setOutputValueClass(NullWritable.class);// 6 设置输入数据和输出数据路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 8 设置reduce端的分组job.setGroupingComparatorClass(OrderGroupingComparator.class);// 7 提交boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

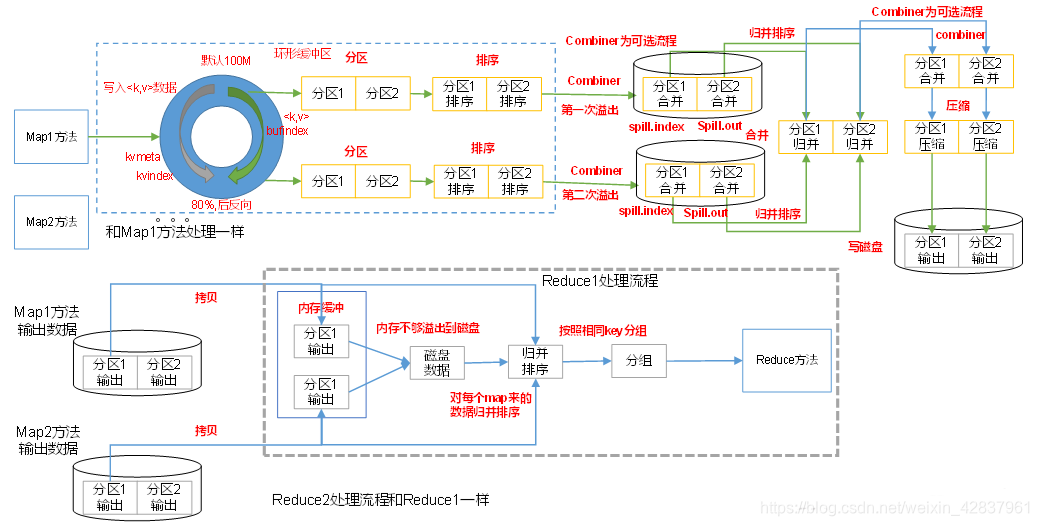

3.4 MapTask 工作机制

-

Read 阶段

MapTask 通过用户编写的 RecordReader,从输入 InputSplit 中解析出一个个 key/value。

-

Map 阶段

该阶段主要是将解析出的 key/value 交给用户编写 map() 函数处理,并产生一系列新的 key/value。

-

Collect 收集阶段

在用户编写 map() 函数中,当数据处理完成后,一般会调用 OutputCollector.collect() 输出结果。在该函数内部,它会将生成的 key/value 分区(调用Partitioner),并写入一个环形内存缓冲区中。

-

Spill 溢写阶段

当环形缓冲区满后,MapReduce 会将数据写到本地磁盘上,生成一个临时文件。需要注意的是,将数据写入本地磁盘之前,先要对数据进行一次本地排序,并在必要时对数据进行合并、压缩等操作。

溢写阶段详情:

① 利用快速排序算法对缓存区内的数据进行排序,排序方式是,先按照分区编号 Partition 进行排序,然后按照 key 进行排序。这样,经过排序后,数据以分区为单位聚集在一起,且同一分区内所有数据按照 key 有序。

② 按照分区编号由小到大依次将每个分区中的数据写入任务工作目录下的临时文件 output/spillN.out(N表示当前溢写次数)中。如果用户设置了 Combiner,则写入文件之前,对每个分区中的数据进行一次聚集操作。

③ 将分区数据的元信息写到内存索引数据结构 SpillRecord 中,其中每个分区的元信息包括在临时文件中的偏移量、压缩前数据大小和压缩后数据大小。如果当前内存索引大小超过 1 MB,则将内存索引写到文件 output/spillN.out.index中。

-

Combine 阶段

当所有数据处理完成后,MapTask 对所有临时文件进行一次合并,以确保最终只会生成一个数据文件。

该文件保存到文件 output/file.out 中,同时生成相应的索引文件 output/file.out.index。在进行文件合并过程中,MapTask 以分区为单位进行合并。对于某个分区,它将采用多轮递归合并的方式。每轮合 io.sort.factor(默认10)个文件,并将产生的文件重新加入待合并列表中,对文件排序后,重复以上过程,直到最终得到一个大文件。

让每个 MapTask 最终只生成一个数据文件,可避免同时打开大量文件和同时读取大量小文件产生的随机读取带来的开销。

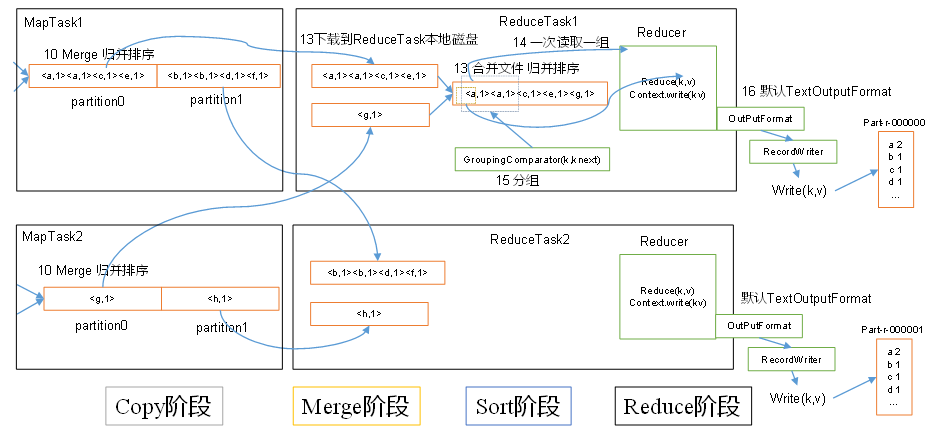

3.5 ReduceTask 工作机制

-

ReduceTask 工作机制

① Copy 阶段ReduceTask 从各个 MapTask 上远程拷贝一片数据,并针对某一片数据,如果其大小超过一定阈值,则写到磁盘上,否则直接放到内存中。

② Merge 阶段

在远程拷贝数据的同时,ReduceTask 启动了两个后台线程对内存和磁盘上的文件进行合并,以防止内存使用过多或磁盘上文件过多。

③ Sort 阶段

按照 MapReduce 语义,用户编写 reduce() 函数输入数据是按 key 进行聚集的一组数据。为了将 key 相同的数据聚在一起,Hadoop 采用了基于排序的策略。由于各个 MapTask 已经实现对自己的处理结果进行了局部排序,因此,ReduceTask 只需对所有数据进行一次归并排序即可。

④ Reduce 阶段

reduce() 函数将计算结果写到 HDFS上。

-

设置 ReduceTask 并行度(个数)

ReduceTask 的并行度同样影响整个 Job 的执行并发度和执行效率,但与 MapTask 的并发数由切片数决定不同,ReduceTask 数量的决定是可以直接手动设置。

// 默认值是1,手动设置为4

job.setNumReduceTasks(4);

-

注意事项

① ReduceTask=0, 示没有 Reduce 阶段, 输出文件个数和 Map 个数一致。

② ReduceTask 默认值就是 1,所以输出文件个数为-一个。

③ 如果数据分布不均匀,就有可能在 Reduce 阶段产生数据倾斜

④ ReduceTask 数量并不是任意设置,还要考虑业务逻辑需求,有些情况下,需要计算全局汇总结果,就只能有 1 个 ReduceTask。

⑤ 具体多少个 ReduceTask, 需要根据集群性能而定。

⑥ 如果分区数不是 1,但是 ReduceTask 为1,是否执行分区过程。笞案是不执行分区过程。因为在 MapTask 的源码中,执行分区的前提是先判断 ReduceNum 个数是否大于 1,不大于 1 肯定不执行。

3.6 OutputFormat 数据输出

3.6.1 OutputFormat 接口实现类

OutputFormat 是 MapReduce 输出的基类,所有实现 MapReduce 输出都实 OutputFormat

接口。下面是几种常见的 OutputFormat 实现类。

-

文本输出 TextOutputFormat

默认的输出格式是 TextOutputForrnat,它把每条记录写为文本行。它的键和值可以是任意类型,因为 TextOutputFormat 调用 toString() 方法把它们转换为字符串。

-

SequenceFileOutputFormat

将 SequenceFileOutputformat 输出作为后续 MapReduce 任务的输入,这便是一种好的输出格式,因为它的格式紧凑,很容易被压缩。

-

自定义 OutputFormat

根据用户需求,自定义实现输出。

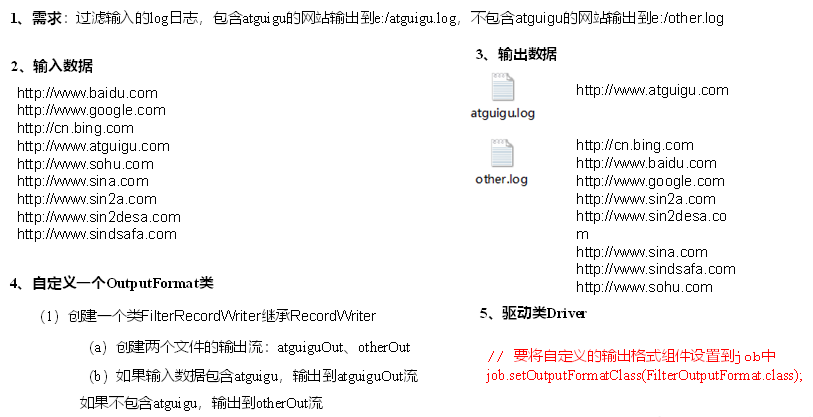

3.6.2 自定义 OutputFormat

-

使用场景

为了实现控制最终文件的输出路径和输出格式,可以自定义 OutputFormat。

例如:要在一个 MapReduce 程序中根据数据的不同输出两类结果到不同目录,这类灵活的输出需求可以通过自定义 OutputFormat 来实现。

-

自定义 OutputFormat 步骤

① 自定义一 个类继承 FileOutputFormat。

② 改写 RecordWiter,具体改写输出数据的方法 write()。

3.6.3 自定义 OutputFormat 案例实操

-

需求

过滤输入的 log 日志,包含 atguigu 的网站输出到 atguigu.log,不包含 atguigu 的网站输出到 other.log。

输入数据

log.txt

http://www.baidu.com

http://www.google.com

http://cn.bing.com

http://www.atguigu.com

http://www.sohu.com

http://www.sina.com

http://www.sin2a.com

http://www.sin2desa.com

http://www.sindsafa.com

-

需求分析

-

代码实现

① 编写 FilterMapper 类

package mr.outputformat;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class FilterMapper extends Mapper<LongWritable, Text, Text, NullWritable> {@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 写出context.write(value, NullWritable.get());}

}② 编写 FilterReducer 类

package mr.outputformat;import java.io.IOException;import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class FilterReducer extends Reducer<Text, NullWritable, Text, NullWritable> {Text k = new Text();@Overrideprotected void reduce(Text key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {// 1 获取一行String line = key.toString();// 2 拼接line = line + "\r\n";// 3 设置keyk.set(line);for (NullWritable value : values) {context.write(k, NullWritable.get());}}

}

③ 自定义一个 FilterOutputFormat 类

package mr.outputformat;import java.io.IOException;import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.RecordWriter;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class FilterOutputFormat extends FileOutputFormat<Text, NullWritable> {@Overridepublic RecordWriter<Text, NullWritable> getRecordWriter(TaskAttemptContext job) throws IOException, InterruptedException {// 创建一个RecordWriterreturn new FilterRecordWriter(job);}

}

④ 编写 FileRecordWriter 类

package mr.outputformat;import java.io.IOException;import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.RecordWriter;

import org.apache.hadoop.mapreduce.TaskAttemptContext;public class FilterRecordWriter extends RecordWriter<Text, NullWritable> {FSDataOutputStream atguiguOut = null;FSDataOutputStream otherOut = null;public FilterRecordWriter(TaskAttemptContext job) {// 1 获取文件系统FileSystem fs;try {fs = FileSystem.get(job.getConfiguration());// 2 创建输出流atguiguOut = fs.create(new Path("f:/0/output/log/atguigu.log"));otherOut = fs.create(new Path("f:/0/output/log/other.log"));} catch (IOException e) {e.printStackTrace();}}@Overridepublic void write(Text key, NullWritable value) throws IOException, InterruptedException {// 判断是否包含“atguigu”输出到不同文件if (key.toString().contains("atguigu")) {atguiguOut.write(key.toString().getBytes());} else {otherOut.write(key.toString().getBytes());}}@Overridepublic void close(TaskAttemptContext context) throws IOException, InterruptedException {// 关闭资源IOUtils.closeStream(atguiguOut);IOUtils.closeStream(otherOut);}

}

⑤ 编写 FilterDriver 类

package mr.outputformat;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class FilterDriver {public static void main(String[] args) throws Exception {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/log.txt", "f:/0/output/outputFormat/"};Configuration conf = new Configuration();Job job = Job.getInstance(conf);job.setJarByClass(FilterDriver.class);job.setMapperClass(FilterMapper.class);job.setReducerClass(FilterReducer.class);job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(NullWritable.class);job.setOutputKeyClass(Text.class);job.setOutputValueClass(NullWritable.class);// 要将自定义的输出格式组件设置到job中job.setOutputFormatClass(FilterOutputFormat.class);FileInputFormat.setInputPaths(job, new Path(args[0]));// 虽然我们自定义了outputformat,但是因为我们的outputformat继承自fileoutputformat// 而fileoutputformat要输出一个_SUCCESS文件,所以,在这还得指定一个输出目录FileOutputFormat.setOutputPath(job, new Path(args[1]));boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

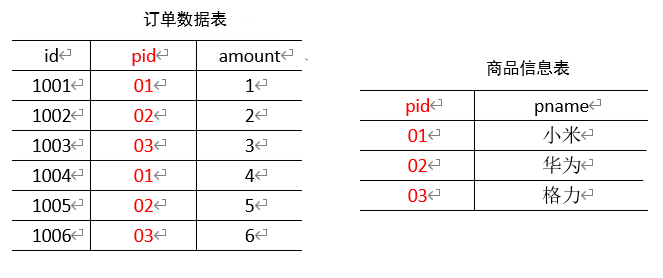

3.7 Join 多种应用

3.7.1 Reduce Join

-

Map 端的主要工作:为来自不同表或文件的 key/value 对,打标签以区别不同来源的记录。然后用连接字段作为 key,其余部分和新加的标志作为 value,最后进行输出。

-

Reduce 端的主要工作:在 Reduce 端以连接字段作为 key 的分组已经完成,我们只需要在每一个分组当中将那些来源于不同文件的记录(在 Map 阶段已经打标志)分开,最后进行合并就 ok 了。

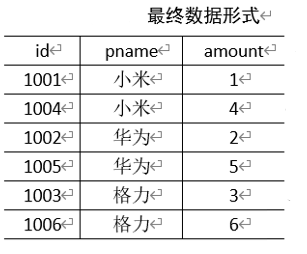

3.7.2 Reduce Join 案例实操

-

需求

将商品信息表中数据根据商品 pid 合并到订单数据表中。

输入数据① order.txt

1001 01 1

1002 02 2

1003 03 3

1004 01 4

1005 02 5

1006 03 6

② pd.txt

01 小米

02 华为

03 格力

-

需求分析

-

代码实现

① 创建商品和订合并后的 TableBean 类

package mr.table;import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;import org.apache.hadoop.io.Writable;public class TableBean implements Writable {private String order_id; // 订单idprivate String p_id; // 产品idprivate int amount; // 产品数量private String pname; // 产品名称private String flag; // 表的标记public TableBean() {super();}public TableBean(String order_id, String p_id, int amount, String pname, String flag) {this.order_id = order_id;this.p_id = p_id;this.amount = amount;this.pname = pname;this.flag = flag;}public String getFlag() {return flag;}public void setFlag(String flag) {this.flag = flag;}public String getOrder_id() {return order_id;}public void setOrder_id(String order_id) {this.order_id = order_id;}public String getP_id() {return p_id;}public void setP_id(String p_id) {this.p_id = p_id;}public int getAmount() {return amount;}public void setAmount(int amount) {this.amount = amount;}public String getPname() {return pname;}public void setPname(String pname) {this.pname = pname;}@Overridepublic void write(DataOutput out) throws IOException {out.writeUTF(order_id);out.writeUTF(p_id);out.writeInt(amount);out.writeUTF(pname);out.writeUTF(flag);}@Overridepublic void readFields(DataInput in) throws IOException {this.order_id = in.readUTF();this.p_id = in.readUTF();this.amount = in.readInt();this.pname = in.readUTF();this.flag = in.readUTF();}@Overridepublic String toString() {return order_id + "\t" + pname + "\t" + amount + "\t";}

}

② 编写 TableMapper 类

package mr.table;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.lib.input.FileSplit;public class TableMapper extends Mapper<LongWritable, Text, Text, TableBean> {String name;TableBean bean = new TableBean();Text k = new Text();@Overrideprotected void setup(Context context) throws IOException, InterruptedException {// 1 获取输入文件切片FileSplit split = (FileSplit) context.getInputSplit();// 2 获取输入文件名称name = split.getPath().getName();}@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取输入数据String line = value.toString();String[] fields = line.split("\t");// 2 不同文件分别处理if (name.startsWith("order")) {// 订单表处理// 2.1 封装bean对象bean.setOrder_id(fields[0]);bean.setP_id(fields[1]);bean.setAmount(Integer.parseInt(fields[2]));bean.setPname("");bean.setFlag("order");k.set(fields[1]);} else {// 产品表处理// 2.2 封装bean对象bean.setP_id(fields[0]);bean.setPname(fields[1]);bean.setFlag("pd");bean.setAmount(0);bean.setOrder_id("");k.set(fields[0]);}// 3 写出context.write(k, bean);}

}

③ 编写 TableReducer 类

package mr.table;import java.io.IOException;

import java.util.ArrayList;import org.apache.commons.beanutils.BeanUtils;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;public class TableReducer extends Reducer<Text, TableBean, TableBean, NullWritable> {@Overrideprotected void reduce(Text key, Iterable<TableBean> values, Context context) throws IOException, InterruptedException {// 1准备存储订单的集合ArrayList<TableBean> orderBeans = new ArrayList<>();// 2 准备bean对象TableBean pdBean = new TableBean();for (TableBean bean : values) {if ("order".equals(bean.getFlag())) {// 订单表// 拷贝传递过来的每条订单数据到集合中TableBean orderBean = new TableBean();try {BeanUtils.copyProperties(orderBean, bean);} catch (Exception e) {e.printStackTrace();}orderBeans.add(orderBean);} else {// 产品表try {// 拷贝传递过来的产品表到内存中BeanUtils.copyProperties(pdBean, bean);} catch (Exception e) {e.printStackTrace();}}}// 3 表的拼接for (TableBean bean : orderBeans) {bean.setPname(pdBean.getPname());// 4 数据写出去context.write(bean, NullWritable.get());}}

}

④ 编写 TableDriver 类

package mr.table;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class TableDriver {public static void main(String[] args) throws Exception {// 0 根据自己电脑路径重新配置args = new String[]{"f:/0/input/ReduceJoin", "f:/0/output/ReduceJoin"};// 1 获取配置信息,或者job对象实例Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 2 指定本程序的jar包所在的本地路径job.setJarByClass(TableDriver.class);// 3 指定本业务job要使用的Mapper/Reducer业务类job.setMapperClass(TableMapper.class);job.setReducerClass(TableReducer.class);// 4 指定Mapper输出数据的kv类型job.setMapOutputKeyClass(Text.class);job.setMapOutputValueClass(TableBean.class);// 5 指定最终输出的数据的kv类型job.setOutputKeyClass(TableBean.class);job.setOutputValueClass(NullWritable.class);// 6 指定job的输入原始文件所在目录FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 7 将job中配置的相关参数,以及job所用的java类所在的jar包, 提交给yarn去运行boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

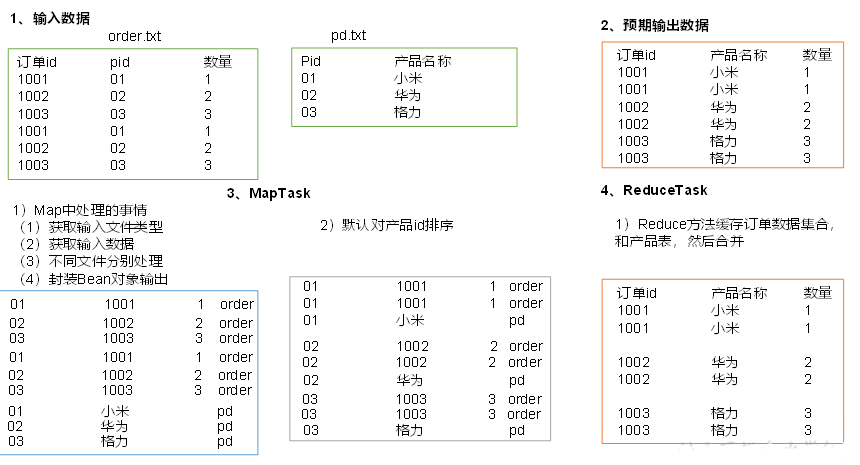

3.7.3 Map Join

-

使用场景

Map Join 适用于一张表十分小、一张表很大的场景。

-

优点

在 Map 端缓存多张表,提前处理业务逻辑,这样增加 Map 端业务,减少 Reduce 端数据的压力,尽可能的减少数据倾斜。

-

具体办法:采用 DistributedCache

① 在 Mapper 的 setup 阶段,将文件读取到缓存集合中。

② 在驱动函数中加载缓存。

// 缓存普通文件到Task运行节点。

job.addCacheFile(new URI("file://e:/cache/pd.txt"));

3.7.4 Map Join 案例实操

-

需求

同 3.7.2

-

需求分析

-

代码实现

① 编写读取缓存文件的 DistributedCacheMapper 类

package mr.cache;import java.io.BufferedReader;

import java.io.FileInputStream;

import java.io.IOException;

import java.io.InputStreamReader;

import java.net.URI;

import java.util.HashMap;

import java.util.Map;import org.apache.commons.lang.StringUtils;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class DistributedCacheMapper extends Mapper<LongWritable, Text, Text, NullWritable> {Map<String, String> pdMap = new HashMap<>();Text k = new Text();@Overrideprotected void setup(Mapper<LongWritable, Text, Text, NullWritable>.Context context) throws IOException, InterruptedException {// 1 获取缓存的文件URI[] cacheFiles = context.getCacheFiles();String path = cacheFiles[0].getPath().toString();BufferedReader reader = new BufferedReader(new InputStreamReader(new FileInputStream(path), "UTF-8"));String line;while (StringUtils.isNotEmpty(line = reader.readLine())) {// 2 切割String[] fields = line.split("\t");// 3 缓存数据到集合pdMap.put(fields[0], fields[1]);}// 4 关流reader.close();}@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取一行String line = value.toString();// 2 截取String[] fields = line.split("\t");// 3 获取产品idString pId = fields[1];// 4 获取商品名称String pdName = pdMap.get(pId);// 5 拼接k.set(line + "\t" + pdName);// 6 写出context.write(k, NullWritable.get());}

}

② 编写 DistributedCacheDriver 类

package mr.cache;import java.net.URI;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class DistributedCacheDriver {public static void main(String[] args) throws Exception {// 0 根据自己电脑路径重新配置args = new String[]{"f:/0/input//ReduceJoin/order.txt", "f:/0/output/cache"};// 1 获取job信息Configuration configuration = new Configuration();Job job = Job.getInstance(configuration);// 2 设置加载jar包路径job.setJarByClass(DistributedCacheDriver.class);// 3 关联mapjob.setMapperClass(DistributedCacheMapper.class);// 4 设置最终输出数据类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(NullWritable.class);// 5 设置输入输出路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 6 加载缓存数据job.addCacheFile(new URI("file:///f:/0/input/ReduceJoin/pd.txt"));// 7 Map端Join的逻辑不需要Reduce阶段,设置reduceTask数量为0job.setNumReduceTasks(0);// 8 提交boolean result = job.waitForCompletion(true);System.exit(result ? 0 : 1);}

}

3.8 计数器应用

Hadoop 为每个作业维护若干内置计数器,以描述多项指标。例如,某些计数器记录已处理的字节数和记录数,使用户可监控已处理的输入数据量和已产生的输出数据量。

-

计数器 API

① 采用枚举的方式统计计数

enum MyCounter{MALFORORMED,NORMAL}

//对枚举定义的自定义计数器加1

context.getCounter(MyCounter.MALFORORMED).increment(1);

② 采用计数器组、计数器名称的方式统计

context.getCounter("coutetGroup", "counter").increment(1);

③ 计数结果在程序运行后的控制台上查看。

-

计数器案例实操

详见 3.9 数据清洗案例。

3.9 数据清洗(ETL)

在运行核心业务 MapReduce 程序之前,往往要先对数据进行清洗,清理掉不符合用户要求的数据。清理的过程往往只需要运行 Mapper 程序,不需要运行 Reduce 程序。

3.9.1 数据清洗案例实操-简单解析版

-

需求

去除日志中字段长度小于等于 11 的日志。

① 输入数据

web.log

② 期望输出数据

每行字段期望输出数据长度都大于11。

-

需求分析

需要在 Map 阶段对输入的数据根据规则进行过滤清洗。

-

代码实现

① 编写 LogMapper 类

package mr.weblog;import java.io.IOException;import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;public class LogMapper extends Mapper<LongWritable, Text, Text, NullWritable> {Text k = new Text();@Overrideprotected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {// 1 获取1行数据String line = value.toString();// 2 解析日志boolean result = parseLog(line, context);// 3 日志不合法退出if (!result) {return;} // 4 设置keyk.set(line);// 5 写出数据context.write(k, NullWritable.get());}// 2 解析日志private boolean parseLog(String line, Context context) {// 1 截取String[] fields = line.split(" ");// 2 日志长度大于11的为合法if (fields.length > 11) {// 系统计数器context.getCounter("map", "true").increment(1);return true;} else {context.getCounter("map", "false").increment(1);return false;}}

}

② 编写 LogDriver 类

package mr.weblog;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class LogDriver {public static void main(String[] args) throws Exception {// 输入输出路径需要根据自己电脑上实际的输入输出路径设置args = new String[]{"f:/0/input/web.log", "f:/0/output/weblog"};// 1 获取job信息Configuration conf = new Configuration();Job job = Job.getInstance(conf);// 2 加载jar包job.setJarByClass(LogDriver.class);// 3 关联mapjob.setMapperClass(LogMapper.class);// 4 设置最终输出类型job.setOutputKeyClass(Text.class);job.setOutputValueClass(NullWritable.class);// 设置reducetask个数为0job.setNumReduceTasks(0);// 5 设置输入和输出路径FileInputFormat.setInputPaths(job, new Path(args[0]));FileOutputFormat.setOutputPath(job, new Path(args[1]));// 6 提交job.waitForCompletion(true);}

}

3.10 MapReduce 开发总结

-

输入数据接口:InputFormat

① 默认使用的实现类是:TextInputFormat

② TextInputFomt 的功能逻辑是:一次读一行文本,然后将该行的起始偏移量作为 key,行内容作为 value 返回。

③ KeyValueTextImputFormat 每一行均为一条记录, 被分隔符分割为 key,value。默认分隔符是 tab (\t)。

④ NlinelnputFormat 按照指定的行数 N 来划分切片。

⑤ CombineTextmputFormat 可以把多个小文件合并成一个切片处理,提高处理效率。

⑥ 用户还可以自定义 InputFormat。 -

逻辑处理接口:Mapper

用户根据业务需求实现其中三个方法:map(),setup(),cleanup()

-

Partitioner 分区

① 有默认实现 HashPrtiner,逻辑是根据 key 的哈希值和 numReduces 来返回一个分区号;key.hashCode()&Integer.MAXVALUE %numReduces

② 如果业务上有特别的需求,可以自定义分区。 -

Comparable 排序

① 当我们用自定义的对象作为 key 来输出时,就必须要实现 WritableComparable 接口,重写其中的compareTo0方法。

② 部分排序:对最终输出的每一个文件进行内部排序。

③ 全排序:对所有数据进行排序,通常只有一个 Reduce。

④ 二次排序:排序的条件有两个。 -

Combiner 合并

Combiner 合并可以提高程序执行效率,减少 IO 传输。但是使用时必须不能影响原有的业务处理结果。

-

Reduce 端分组:GroupingComparator

在 Reduce 端对 key 进行分组。应用于:在接收的 key 为 bean 对象时,想让一个或几个字段相同(全部字段比较不相同)的 key 进入到同一个 reduce 方法时,可以采用分组排序。

-

逻辑处理接口:Reducer

用户根据业务需求实现其中三个方法:reduce(),setup(),cleanup()

-

输出数据接口:OutputFormat

① 默认实现类是 TextOutputFomat,功能逻辑是:将每一个 KV 对,向目标文本文件输出一行。

② 将 SequenceFileOutputFormat 输出作为后续 MapReduce 任务的输入,这便是一种好的输出格式,因为它的格式紧凑,很容易被压缩。

③ 用户还可以自定义 OutputFormat。

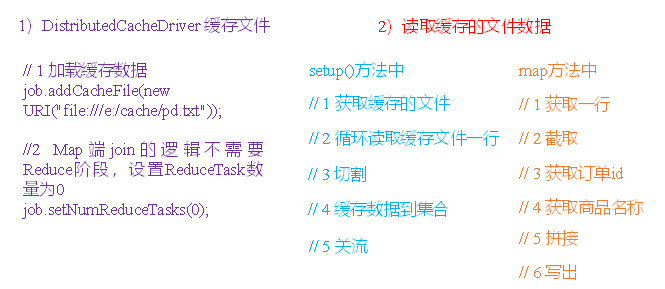

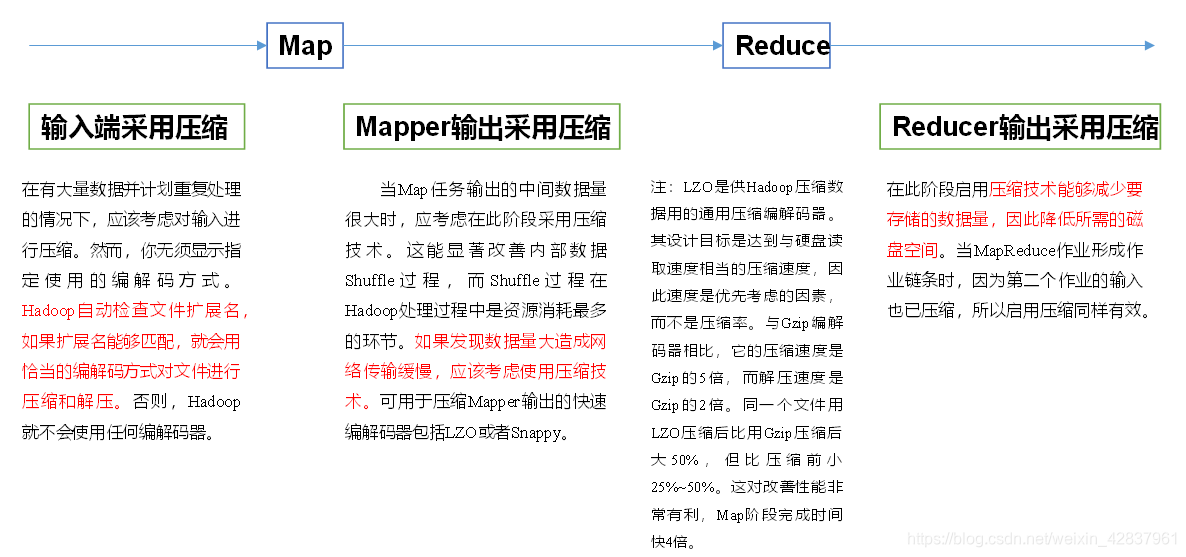

4. Hadoop 数据压缩

4.1 概述

-

压缩概述

压缩技术能够有效减少底层存储系统(HDFS)读写字节数。压缩提高了网络带宽和磁盘空间的效率。在运行 MR 程序时,IO操作、网络数据传输、Shuffe 和 Merge 要花大量的时间,尤其是数据规模很大和工作负载密集的情况下,因此,使用数据压缩显得非常重要。

鉴于磁盘 IO 和网络带宽是 Hadoop 的宝贵资源,数据压缩对于节省资源最小化磁盘 I/O 和网络传输非常有帮助。可以在任意 MapReduce 阶段启用压缩。不过,尽管压缩与解压操作的 CPU 开销不高,其性能的提升和资源的节省并非没有代价。

-

压缩策略和原则

压缩是提高 Hadoop 运行效率的一种优化策略。

通过对 Mapper、Reducer 运行过程的数据进行压缩,以减少磁盘IO,提高 MR 程序运行速度。注意: 采用压缩技术减少了磁盘 IO,但同时增加了 CPU 运算负担。所以,压缩特性运用得当能提高性能,但运用不当也可能降低性能。

压缩基本原则:

① 运算密集型的 job,少用压缩

② IO 密集型的job,多用压缩

4.2 MR 支持的压缩编码

| 压缩格式 | hadoop 自带? | 算法 | 文件扩展名 | 是否可切分 | 换压缩格式后, 原程序是否需要修改 |

对应的编码/解码器 |

|---|---|---|---|---|---|---|

| DEFLATE | 是,直接使用 | DEFLATE | .deflate | 否 | 和文本处理一样,不需要修改 | org.apache.hadoop.io.compress.DefaultCodec |

| Gzip | 是,直接使用 | DEFLATE | .gz | 否 | 和文本处理一样,不需要修改 | org.apache.hadoop.io.compress.GzipCodec |

| bzip2 | 是,直接使用 | bzip2 | .bz2 | 是 | 和文本处理一样,不需要修改 | org.apache.hadoop.io.compress.BZip2Codec |

| LZO | 否,需要安装 | LZO | .lzo | 是 | 要建索引,还要指定输入格式 | com.hadoop.compression.lzo.LzopCodec |

| Snappy | 否,需要安装 | Snappy | .snappy | 否 | 和文本处理一样,不需要修改 | org.apache.hadoop.io.compress.SnappyCodec |

| 压缩算法 | 原始文件大小 | 压缩文件大小 | 压缩速度 | 解压速度 |

|---|---|---|---|---|

| gzip | 8.3GB | 1.8GB | 17.5MB/s | 58MB/s |

| bzip2 | 8.3GB | 1.1GB | 2.4MB/s | 9.5MB/s |

| LZO | 8.3GB | 2.9GB | 49.3MB/s | 74.6MB/s |

在 64 位模式下的酷睿 i7 处理器的单个内核上,Snappy 以大约 250 MB/秒或更块的速度压缩,并在大约 500 MB/秒或以上解压缩。

4.3 压缩方式选择

4.3.1 Gzip 压缩

-

优点

① 压缩率比较高,而且压缩解压速度也比较快;

② Hadoop 本身支持,在应用中处理 Gzip 格式的文件就和直接处理文本一样;

③ 大部分 Linux 系统都自带 Gzip 命令,使用方便。 -

缺点

不支持 Split。

-

应用场景

当每个文件压缩之后在 130M 以内的(1个块大小内),都可以考虑用 Gzip 压缩格式。例如说一天或者一个小时的日志压缩成一个 Gzip 文件。

4.3.2 Bzip2 压缩

-

优点

① 支持 Split;

② 具有很高的压缩率,比 Gzip.压缩率高;;

③ Hadoop 本身自带,使用方便。 -

缺点

压缩解压速度慢。

-

应用场景

① 对速度要求不高,但需要较高的压缩率的时候;

② 输出之后的数据比较大,处理之后的数据需要压缩存档咸少磁盘空间并且以后数据用得比较少的情况;

③ 对单个很大的文本文件想压缩减少存储空间,同时又需要支持 Split,而且兼容之前的应用程序的情况。

4.3.3 Lzo 压缩

-

优点

① 压缩/解压速度也比较快,合理的压缩率;

② 支持 Split,是 Hadoop 中最流行的压缩格式;

③ 可以在 Linux 系统下安装 lzop 命令,使用方便。 -

缺点

① 压缩率比 Gzip 要低一些;

② Hadoop 本身不支持,需要安装;

③ 在应用中对 Lzo 格式的文件需要做一些特殊处理(为了支持 Split 需要建索引,还需要指定 InputFormat 为 Lzo 格式)。 -

应用场景

一个很大的文本文件,压缩之后还大于 200M 以上的可以考虑,而且单个文件越大,Lzo 优点越越明显。

4.3.4 Snappy 压缩

-

优点

高速压缩速度和合理的压缩率。

-

缺点

① 不支持 Split;

② 压缩率比 Gzip 要低;;

③ Hadoop 本身不支持,需要安装。 -

应用场景

① 当 MapReduce 作业的 Map 输出的数据比较大的时候,作为 Map 到 Reduce 的中间数据的压缩格式;

② 作为一个 MapReduce 作业的输出和另外一个 MapReduce 作业的输入。

4.4 压缩位置选择

压缩可以在 MapReduce 作用的任意阶段启用。

4.5 压缩参数配置

要在 Hadoop 中启用压缩,可以配置如下参数:

| 参数 | 默认值 | 阶段 | 建议 |

|---|---|---|---|

| io.compression.codecs (在 core-site.xml 中配置) |

org.apache.hadoop.io.compress.DefaultCodec, org.apache.hadoop.io.compress.GzipCodec, org.apache.hadoop.io.compress.BZip2Codec |

输入压缩 | Hadoop 使用文件扩展名判断是否支持某种编解码器 |

| mapreduce.map.output.compress (在 mapred-site.xml 中配置) |

false | mapper 输出 | 这个参数设为 true 启用压缩 |

| mapreduce.map.output.compress.codec (在 mapred-site.xml 中配置) |

org.apache.hadoop.io.compress.DefaultCodec | mapper 输出 | 企业多使用 LZO 或 Snappy 编解码器在此阶段压缩数据 |

| mapreduce.output.fileoutputformat.compress (在 mapred-site.xml 中配置) |

false | reducer 输出 | 这个参数设为 true 启用压缩 |

| mapreduce.output.fileoutputformat.compress.codec (在 mapred-site.xml 中配置) |

org.apache.hadoop.io.compress.DefaultCodec | reducer 输出 | 使用标准工具或者编解码器,如 gzip 和 bzip2 |

| mapreduce.output.fileoutputformat.compress.type (在 mapred-site.xml 中配置) |

RECORD | reducer 输出 | SequenceFile 输出使用的压缩类型:NONE 和 BLOCK |

4.6 压缩实操案例

4.6.1 数据流的压缩和解压缩

-

CompressionCodec 有两个方法可以用于轻松地压缩或解压缩数据。

① 要想对正在被导入一个输出流的数据进行压缩,我们可以使用 createOutputStream(OutputStream out) 方法创建一个 CompressionOutputStream,将其以压缩格式写入底层的流。

② 相反,要想对从输入流读取而来的数据进行解压缩,则调用 createInputStream(InputStream in) 函数,从而获得一个 CompressionInputStream,从而从底层的流读取未压缩的数据。

-

测试一下如下压缩方式

| 压缩格式 | 对应的编码/解码器 |

|---|---|

| DEFLATE | org.apache.hadoop.io.compress.DefaultCodec |

| gzip | org.apache.hadoop.io.compress.GzipCodec |

| bzip2 | org.apache.hadoop.io.compress.BZip2Codec |

package mr.compress;import java.io.File;

import java.io.FileInputStream;

import java.io.FileNotFoundException;

import java.io.FileOutputStream;

import java.io.IOException;import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.io.compress.CompressionCodecFactory;

import org.apache.hadoop.io.compress.CompressionInputStream;

import org.apache.hadoop.io.compress.CompressionOutputStream;

import org.apache.hadoop.util.ReflectionUtils;public class TestCompress {public static void main(String[] args) throws Exception {// 压缩compress("f:/0/input/compress/hello.txt", "org.apache.hadoop.io.compress.BZip2Codec");

// compress("f:/0/input/compress/hello.txt", "org.apache.hadoop.io.compress.GzipCodec");

// compress("f:/0/input/compress/hello.txt", "org.apache.hadoop.io.compress.DefaultCodec");// 解压缩

// decompress("f:/0/input/compress/hello.txt.bz2");

// decompress("f:/0/input/compress/hello.txt.gz");

// decompress("f:/0/input/compress/hello.txt.deflate");}// 1、压缩private static void compress(String filename, String method) throws Exception {// (1)获取输入流FileInputStream fis = new FileInputStream(new File(filename));Class codecClass = Class.forName(method);CompressionCodec codec = (CompressionCodec) ReflectionUtils.newInstance(codecClass, new Configuration());// (2)获取输出流FileOutputStream fos = new FileOutputStream(new File(filename + codec.getDefaultExtension()));CompressionOutputStream cos = codec.createOutputStream(fos);// (3)流的对拷IOUtils.copyBytes(fis, cos, 1024 * 1024 * 5, false);// (4)关闭资源cos.close();fos.close();fis.close();}// 2、解压缩private static void decompress(String filename) throws FileNotFoundException, IOException {// (0)校验是否能解压缩CompressionCodecFactory factory = new CompressionCodecFactory(new Configuration());CompressionCodec codec = factory.getCodec(new Path(filename));if (codec == null) {System.out.println("cannot find codec for file " + filename);return;}// (1)获取输入流CompressionInputStream cis = codec.createInputStream(new FileInputStream(new File(filename)));// (2)获取输出流FileOutputStream fos = new FileOutputStream(new File(filename + ".decoded"));// (3)流的对拷IOUtils.copyBytes(cis, fos, 1024 * 1024 * 5, false);// (4)关闭资源cis.close();fos.close();}

}

4.6.2 Map 输出端采用压缩

即使 MapReduce 的输入输出文件都是未压缩的文件,但仍然可以对 Map 任务的中间结果输出做压缩,因为它要写在硬盘并且通过网络传输到 Reduce 节点,对其压缩可以提高很多性能,这些工作只要设置两个属性即可。

在驱动类中添加如下内容:

// 开启map端输出压缩

conf.setBoolean("mapreduce.map.output.compress", true);

// 设置map端输出压缩方式

conf.setClass("mapreduce.map.output.compress.codec", BZip2Codec.class, CompressionCodec.class);

4.6.3 Reduce 输出端采用压缩

在驱动类中添加如下内容:

// 设置reduce端输出压缩开启

FileOutputFormat.setCompressOutput(job, true);

// 设置压缩的方式

FileOutputFormat.setOutputCompressorClass(job, BZip2Codec.class);

// FileOutputFormat.setOutputCompressorClass(job, GzipCodec.class);

// FileOutputFormat.setOutputCompressorClass(job, DefaultCodec.class);

5. Yarn 资源调度器

5.1 Yarn 基本架构

YARN 主要由 ResourceManager、NodeManager、ApplicationMaster 和 Container 等组件构成。

5.2 Yarn 工作机制

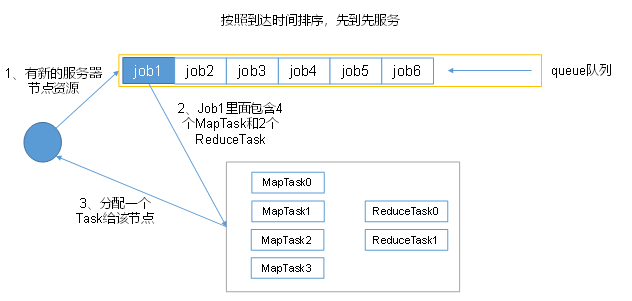

(1)MR 程序提交到客户端所在的节点。

(2)YarnRunner 向 ResourceManager 申请一个 Application。

(3)RM 将该应用程序的资源路径返回给 YarnRunner。

(4)该程序将运行所需资源提交到 HDFS 上。

(5)程序资源提交完毕后,申请运行 mrAppMaster。

(6)RM 将用户的请求初始化成一个 Task。

(7)其中一个 NodeManager 领取到 Task 任务。

(8)该 NodeManager 创建容器 Container,并产生 MRAppmaster。

(9)Container 从 HDFS 上拷贝资源到本地。

(10)MRAppmaster 向 RM 申请运行 MapTask 资源。

(11)RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManage r分别领取任务并创建容器。

(12)MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个 NodeManager 分别启动MapTask,对数据分区排序。

(13)MrAppMaster 等待所有 MapTask 运行完毕后,向 RM 申请容器,运行 ReduceTask。

(14)ReduceTask 向 MapTask 获取相应分区的数据。

(15)程序运行完毕后,MR 会向 RM 申请注销自己。

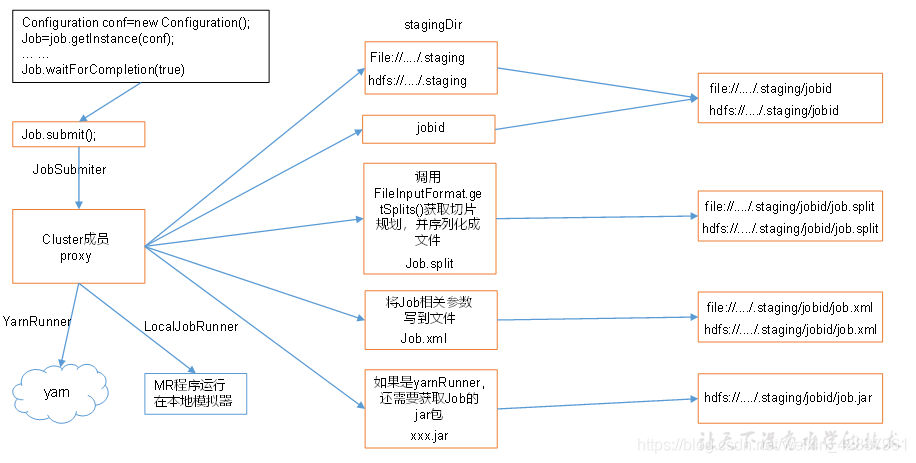

5.3 作业提交全过程

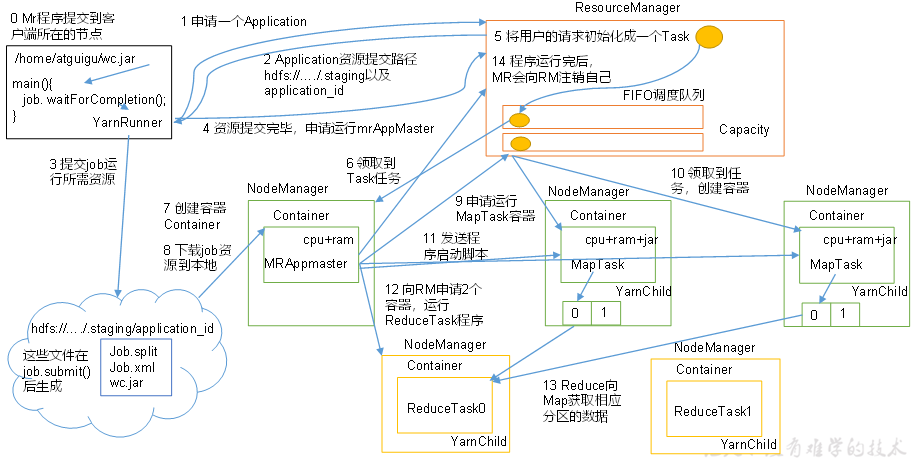

5.3.1 作业提交过程之 YARN

-

作业提交

第1步:Client 调用 job.waitForCompletion 方法,向整个集群提交 MapReduce 作业。

第2步:Client 向 RM 申请一个作业 id。

第3步:RM 给 Client 返回该 job 资源的提交路径和作业 id。

第4步:Client 提交 jar 包、切片信息和配置文件到指定的资源提交路径。

第5步:Client 提交完资源后,向 RM 申请运行 MrAppMaster。 -

作业初始化

第6步:当 RM 收到 Client 的请求后,将该 job 添加到容量调度器中。

第7步:某一个空闲的 NM 领取到该 Job。

第8步:该NM创建Container,并产生 MRAppmaster。

第9步:下载 Client 提交的资源到本地。 -

任务分配

第10步:MrAppMaster 向 RM 申请运行多个 MapTask 任务资源。

第11步:RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManager 分别领取任务并创建容器。 -

任务运行

第12步:MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个 NodeManager 分别启动 MapTask,MapTask 对数据分区排序。

第13步:MrAppMaster 等待所有 MapTask 运行完毕后,向 RM 申请容器,运行 ReduceTask。

第14步:ReduceTask 向 MapTask 获取相应分区的数据。

第15步:程序运行完毕后,MR 会向 RM 申请注销自己。 -

进度和状态更新

YARN 中的任务将其进度和状态(包括 counter)返回给应用管理器, 客户端每秒(通过mapreduce.client.progressmonitor.pollinterval 设置)向应用管理器请求进度更新, 展示给用户。

-

作业完成

除了向应用管理器请求作业进度外, 客户端每 5 秒都会通过调用 waitForCompletion() 来检查作业是否完成。时间间隔可以通过 mapreduce.client.completion.pollinterval 来设置。作业完成之后, 应用管理器和 Container 会清理工作状态。作业的信息会被作业历史服务器存储以备之后用户核查。

5.3.2 作业提交过程之 MapReduce

5.4 资源调度器

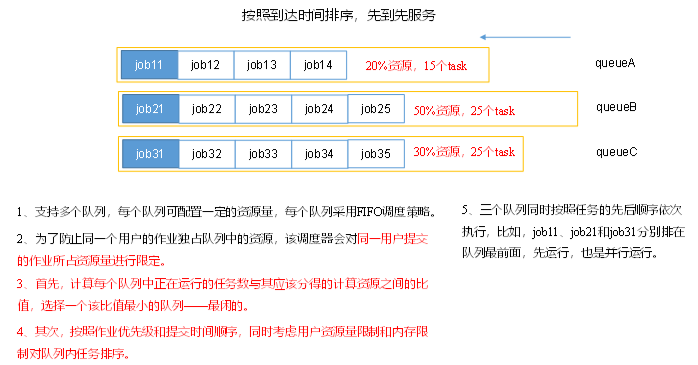

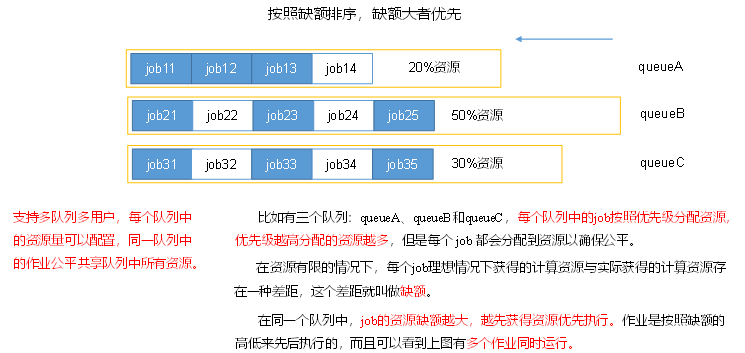

目前,Hadoop 作业调度器主要有三种:FIFO、Capacity Scheduler 和 Fair Scheduler。Hadoop2.7.7 默认的资源调度器是 Capacity Scheduler。

- 先进先出调度器(FIFO)

- 容量调度器(Capacity Scheduler)

- 公平调度器(Fair Scheduler)

5.5 任务的推测执行

-

作业完成时间取决于最慢的任务完成时间

-

推测执行机制

发现拖后腿的任务,比如某个任务运行速度远慢于任务平均速度。为拖后腿任务启动一个备份任务,同时运行。谁先运行完,则采用谁的结果。

-

执行推测任务的前提条件

(1)每个 Task 只能有一个备份任务

(2)当前 Job 已完成的 Task 必须不小于 0.05(5%)

(3)开启推测执行参数设置。mapred-site.xml 文件中默认是打开的。 -

不能启用推测执行机制情况

(1)任务间存在严重的负载倾斜;